0 引言

时间序列是系统中的观测变量按照时间顺序排列的一组数字序列,它可以描述复杂系统的动态特性[1].通过研究时间序列,可以揭示复杂系统的演化规律.因此,时间序列分析与预测是探究复杂系统机理、建立系统模型的重要手段.传统的时间序列预测通常采用基于统计学方法的回归模型来执行预测任务,如:AR、ARMA、ARIMA、ARCH等方法.在神经网络、支持向量机等方法兴起之前,这些方法针对单一时间序列的预测取得了较好预测效果.然而,随着传感器及物联网技术的发展[2],从复杂系统中获得的采样数据呈现出多变量及大规模的特点.同时,受系统演化及外界干扰影响,数据呈现非平稳、含噪声等特点.而传统的统计学习建模方法难以表征多个变量之间的影响关系,在复杂系统建模任务中无法取得令人满意的结果.因此,基于机器学习方法的混沌时间序列建模研究成为这一领域的研究热点问题.

在混沌时间序列建模研究中,相空间重构是系统建模的关键步骤[3].根据Takens嵌入定理,混沌动态系统可以从时间序列中重构,并复现混沌系统的演化信息.对于给定的一元时间序列,相空间重构方法如下所示.给定时间序列xt,嵌入维数为m,延迟时间为τ,则相空间重构之后的向量为

|

其中,嵌入维数及延迟时间可以通过多种方法求解.一种观点认为二者可以分别求得,其中嵌入维数可以通过伪最近邻法、饱和关联维数法、Cao方法、最小描述长度等进行求解[4-5],延迟时间可以通过自相关法、互信息[6]等进行计算;另一种观点认为嵌入维数和延迟时间是存在关联的,二者可以同时求取,典型代表有C-C法[7]等.理论上,一元时间序列通过相空间重构之后,能够重构出混沌系统的演化信息.然而,在实际中,一元时间序列难以保证充分表征动态系统.多元时间序列包含了更多系统演化信息,可以为复杂系统建模提供帮助[8-9].

对于多元时间序列{xi,t|i=1,2,…,L},其相空间重构的普遍做法是将每一维序列经过相空间重构之后,将多个向量依次排列.给定嵌入维数为m =[m1,m2,…,mL],延迟时间为τ =[τ1,τ2,…,τL],则经过多元相空间重构之后的向量为

|

然而,简单地将一元时间序列重构方法应用于多元时间序列相空间重构中可能存在冗余信息等问题[10]. Judd和Mees[11]提出非均匀相空间重构方法,对于复杂的混沌系统建模更有帮助. Faes等人[12]提出了一种基于修正条件熵准则的多元时间序列非均匀嵌入方法. Shen等人[13]提出将嵌入维数和延迟时间的计算分开,使用蚁群算法优化非均匀相空间重构参数,更加快速地搜索参数空间. Han等人[3]提出了一种新型的多元混沌时间序列的非均匀相空间重构方法,根据联合互信息的低维近似准则计算延迟时间,通过条件熵计算嵌入维数,将相空间重构问题转化为一个全局优化问题求解,避免传统相空间重构中的信息冗余问题,在多元混沌时间序列的相空间重构中可以起到较好的效果.相空间重构对于复杂动态系统建模至关重要.然而,现有的相空间重构方法大都从信息理论等角度出发,与后续的复杂系统建模过程分离开.而且,基于群智能优化的求解方法在大规模时间序列应用中无法适用.因此,在系统建模中如何有效重构系统的动态信息是研究者们持续关注的话题[14].最近,有研究表明在进行相空间重构过程中可以选取比实际需求更多的延迟嵌入样本,然后自动地学习其低维嵌入[15].这种方法可能为动态系统的研究带来很大的帮助.

目前已经存在很多时间序列建模综述论文. Längkvist等人[16]对时间序列建模中的无监督表征学习和深度学习模型进行了综述,描述了视频时间序列建模在深度学习和无监督特征学习中的进展.然而复杂系统中的时间序列相比于视频时间序列,数据动态特性更强,各个变量之间存在明显的关联关系.现有的大多数无监督学习及深度学习手段一般用于静态数据建模,将这些方法用于复杂系统的时间序列建模中存在一定的挑战. Stulp等人[17]阐述了时间序列回归中多种经典回归方法的关联关系,从回归模型的角度对时间序列预测的方法进行了综述.其在综述中表明,加权基函数模型是混合线性模型的特殊情况,为时间序列回归中预测模型的选取提供了一定理论依据. Li等人[18]对交通时间序列的趋势建模进行了完整的综述,重点对交通流量预测、交通数据压缩、异常交通数据检测、缺失交通数据补全进行了研究. Han等人[19]对二阶模糊神经网络用于混沌时间序列预测问题进行了综述,并提供了此类方法的结构设计与参数优化的指导.

与上述时间序列综述论文相比,本文的研究对象是复杂系统中的混沌时间序列,更加强调复杂系统中多个变量之间的影响关系,而不仅仅是针对单一变量的时间序列进行预测.在研究内容上,本文根据实际的复杂系统时间序列存在的特性及问题,总结出混沌时间序列建模预测中的几个主要研究热点问题.针对混沌时间序列中的多变量、含噪声、非平稳、中长期等问题分别阐述,为相关领域的研究者提供比较详细的问题展示以及最新发展趋势.

1 多元混沌时间序列的降维方法随着传感器网络技术的发展,复杂系统采样所获得的混沌时间序列呈现多元的特点.多元指的是采集获得的数据集中含有复杂系统中多个不同属性、不同位置的数据.传统的时间序列建模方法关注于系统中某一个变量的未来走向与趋势.而在进行多元混沌时间序列建模时,学者们更关注整个复杂系统中多个变量之间的相互影响关系,以及整个系统的未来演化趋势,以便为动态系统的决策与控制做准备.与图像数据的维度不同,多元混沌时间序列中蕴含的信息比图像数据更丰富,更注重时序的语义信息.因此,如何在建模过程中对多元混沌时间序列进行数据融合,使降维之后的数据更能够代表动态系统的演化规律成为多元混沌时间序列建模中的关键性问题.

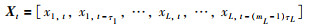

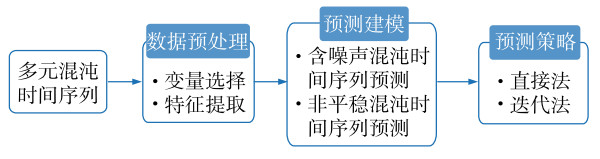

本节的主要思路如图 1所示.在对多元混沌时间序列的建模研究中,学者们主要通过时间序列数据的变量选择、特征提取等方面着手,达到约简特征维度,提取重要信息的效果,使用对复杂系统影响较大的状态变量来建模,避免无关、冗余信息使模型的性能退化.

|

| 图 1 多元混沌时间序列降维处理示意图 Fig.1 Schematic diagram of dimensionality reduction processing for multivariate chaotic time series |

多元时间序列变量间往往存在着复杂的关联关系,如何有效刻画多个变量间的影响关系,选择有效的模型输入变量,直接影响着复杂系统的建模精度.变量选择[20]是指在满足一定的预测性能要求下,将原始高维输入数据集中的无关及冗余变量进行去除,对相关变量进行保留,进而筛选出一个足以包含变量间相关信息的最优子集来代替原始的高维输入变量集合,进而实现简化预测模型、提高预测性能的目的.变量选择也称为特征选择或变量子集选择,其流程图如图 2所示,包括4个步骤:子集生成、子集评价、终止条件判断以及子集验证[21].目前主要集中于子集评价的研究,按照子集评价标准可以分为过滤式、封装式和嵌入式三类方法[22].其中,过滤式变量选择方法直接考虑变量之间的信息包含程度,在不考虑后续建模的情况下选择有效变量;封装式变量选择方法考虑后续建模效果,以最终建模精度为准则选择输入变量,具有较高的计算复杂度;嵌入式变量选择方法同时进行模型训练与输入变量选择,它结合了学习算法来评价所选择子集性能.

|

| 图 2 变量选择的基本框架 Fig.2 The basis steps of variable selection |

过滤式变量选择方法是一种在模型建立之前进行数据预处理的方法,其所选择的变量子集与预测模型的性能无关.过滤式变量选择方法大多数以信息准则为依据[23],在变量选择过程中考虑输入变量之间的关联关系,选择对模型输出最有价值的变量,约简无关、冗余变量.其中,典型的方法有互信息、灰色关联分析等.韩敏等人[24]根据变量间的相关关系,以输入变量间的k-近邻互信息变化率作为评价标准选择相关变量,判断是否为冗余变量的依据是输入变量子集之间互信息值的大小,最终实现输入变量选择. Han等人[25]提出了一种基于Copula熵的高维互信息估计方法,该方法是一种基于数据的非参数方法,无需对数据分布进行先验假设,采用计算效率较高的顺序前向搜索策略,使得该方法可以应用于高维输入变量选择中. Han等人[26]提出了一种基于单目标和多目标优化的全局互信息变量选择算法,通过将互信息变量选择转换为全局优化问题,避免了传统互信息变量选择求解过程中的局部最优,获得了较好的输入变量选择效果.韩敏等人[27]提出了一种基于相对变化面积的改进灰色关联分析的变量选择方法,这种方法以序列几何形状的相似程度为基础,衡量不同输入变量之间的相关关系.

过滤式变量选择方法所选择的变量子集与预测模型无关,无法直接判断预测精度受输入变量的影响大小.而封装式变量选择方法以最终建模结果为评价准则,与预测模型的关系更加密切,其目标导向性更明显.因此,此类方法一般得到的预测效果更理想. Guyon等人[28]提出了一种基于递归特征消除的支持向量机变量选择方法.该方法将支持向量机的分类性能作为变量子集的评价标准,并应用于基因变量选择上,能够自动的消除冗余信息,产生更好、更紧凑的变量子集.

嵌入式变量选择方法采用学习算法的结构参数等准则来评价所选择变量子集的优劣,同时兼备了过滤式方法的效率和封装式算法的精度. Han等人[29]将偏最小二乘法用于极限学习机的变量选择中,组合的变量选择算法结合了过滤式和封装式变量选择的优点,这种方法可以有效地增强模型的预测性能并且提高可靠性.稀疏学习[30]是一种有效的特征选择方法,通过在模型的目标函数中添加稀疏正则化惩罚项,将无关变量的系数收缩为零,最终得到具有非零权值的最优变量集合,代表性方法有L1范数、L2,1范数、L2,1-2范数以及群组正则化等方法.

1.2 特征提取在多元混沌时间序列建模中,输入变量的特征融合对复杂系统的建模至关重要.在异源传感器的数据中,特征提取与数据融合近似等价.特征提取是指采用映射或变换的方法,将原始高维数据转换到低维特征空间中,从而达到降维的目的.在对复杂系统进行分析时,其中一个主要问题来自所涉及的变量数量.在对规模较大的变量进行分析时,通常需要大量的内存开销和较强的计算能力,并且学习算法训练数据样本时,可能出现过拟合现象,导致对新样本的泛化能力较差.特征提取是构造变量组合的方法的通称,该类方法在对数据进行足够准确描述的同时,可以有效克服上述问题.合适的特征融合方法将使建模过程更简单,很多学者将主成分分析等方法用于高维时间序列,以达到约简特征维度、实现特征提取的效果.

当对中国上百个城市的降雨量进行建模预测时,Zhang等人[31]使用主成分分析(PCA)对当地的13个物理因子进行维度约简与特征提取,将约简之后的融合特征作为多层感知机的输入,以实现大范围的短期降雨量预测. Liu等人[32]提出了采用图形处理单元并行处理大数据的稀疏PCA(SPCA)方法,相比于传统的PCA方法,不但极大地减少了计算量,并且也节省了内存开销.虽然PCA算法广泛应用于降维处理中,但其存在着不能一致地选择有用的特征、对异常值敏感等缺点. Yi等人[33]提出了一种新的联合稀疏PCA(JSPCA)方法,JSPCA放宽了变换矩阵的正交约束,使其有更多的自由来共同选择有用的特征进行低维表示,用于联合选择有用的特征,同时JSPCA对其目标函数施加联合稀疏约束,即在损失函数项和正则化项上均施加L2,1范数,以提高算法的鲁棒性.

随着传感器网络的发展,数据多样性为系统建模带来了挑战.在大规模时间序列建模中,数据集中包含来自不同领域的多种模态.通过主成分分析等方法直接对不同来源的时间序列数据进行建模的解释性较差,无法实现精准的动态系统演化推断. Zheng[34]在综述论文中将跨领域的数据融合方法分为四类:基于多视角学习的方法,基于相似性学习的方法,基于概率依赖的方法以及基于迁移学习的方法.面向大规模多元混沌时间序列建模在未来一定是考虑多领域、不同来源的数据进行建模.因此,跨领域、异源的多元混沌时间序列建模任务中的变量选择和特征提取研究很有必要.

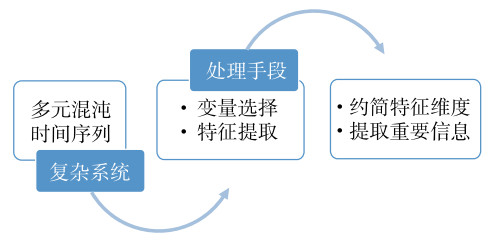

2 含噪声混沌时间序列预测在动态系统中,由于传感器的故障以及系统的极端事件影响,从实际复杂系统中采集的混沌时间序列可能含有大量噪声及离群值.同时,由于数据传输以及数据存储过程中的故障,可能会导致采样的时间序列中存在大量噪声.本节内容按照图 3所示的结构展开,主要包括混沌时间序列去噪方法以及三种鲁棒建模方法.

|

| 图 3 含噪声混沌时间序列预测结构图 Fig.3 Structure diagram of noisy chaotic time series prediction |

将含噪声混沌时间序列输入到模型中可能会使系统建模精度降低,甚至导致模型失效.对含噪声的混沌时间序列进行数据预处理可以有效降低时间序列的不确定性,为后续的系统建模以及预测任务提供帮助.

针对时间序列信息稀疏、序列较短、混沌动力学未知的情形,韩敏等人[35-36]采用小波变换阈值决策的方法,实现了对混沌信号去噪的目的,在混沌动力学特性未知、小规模的混沌序列上获得了较好的效果.席剑辉等人[37]提出了一种改进的非线性局部平均去噪方法,这种算法基于相空间重构理论,考虑了重构之后的混沌系统的不同点对相空间的贡献.去噪后的时间序列的伪最近邻点比率以及混沌吸引子结构可以表明,这些方法能够较好地实现混沌时间序列去噪,为后续建模提供一定的帮助.然而,随着时间序列的实时到达以及多元时间序列建模的要求,传统的混沌时间序列建模方法无法实现增量式的数据去噪,同时这些去噪方法可能会将混沌系统的演化信息掩盖,导致建模过程的失效.因此,有很多学者选择鲁棒建模的方式来减弱噪声的影响,同时不损失动态系统的演化信息.

2.2 含噪声混沌时间序列的鲁棒建模方法在研究含噪声的时间序列建模预测问题时,学者们提出了多种手段以解决这一问题.本节主要讨论鲁棒损失函数建模、数据分布假设建模以及基于贝叶斯推理的建模方法.

一些学者采用鲁棒损失函数处理噪声的影响[38],通过修改模型损失函数对噪声的敏感程度,以达到鲁棒建模的效果. Lee等人[39]提出了一种改进的鲁棒Hample的M估计的激活函数,以解决传统径向基函数神经网络对噪声及离群值敏感的问题. Xia等人[38]将Huber M-估计引入到二维递归神经网络中,将求解问题转化为二次规划问题,在保证不损失精度的前提下,算法的复杂度也得到了一定程度降低. Shi等人[40]在支持向量回声状态机中引入了鲁棒Huber损失函数,改善了模型的鲁棒性与泛化性能.由于经典的极限学习机的L2范数损失函数对噪声敏感,Chen等人[41]在极限学习机中同时考虑了L1范数和Huber损失函数,并结合多种正则化手段以提升模型的抗噪能力. Lu等人[42]通过考虑样本的均值和方差,构造了一个新的鲁棒损失函数,这种方法对非高斯分布数据及离群值取得了较好的效果.鲁棒损失函数从模型训练的角度来防止噪声值对模型产生不利影响,在一定程度上增加了模型的抗噪能力.

除了鲁棒损失函数之外,也有学者在建模时考虑数据分布的问题.在建立时间序列预测模型时,假设数据不服从高斯分布,而是服从多种长尾分布,如学生-t分布或拉普拉斯分布等.在某种情况下,这种假设更符合实际情况. Jylanki等人[43]使用学生-t分布假设代替数据的高斯分布假设,在高斯过程回归模型上获得了更加鲁棒的效果,并且获得了较好的时间序列预测效果. Li等人[44]提出了一种新型的回声状态网络模型,使用拉普拉斯似然函数代替高斯似然函数作为模型输出的似然函数,并且在贝叶斯框架下使用高斯分布来逼近拉普拉斯似然函数,同时保证了模型对离群值的鲁棒性. Vukovic等人[45]通过长尾分布假设,提出了一种对离群值鲁棒的扩展卡尔曼滤波器用于前馈神经网络的在线学习.然而,这些基于非高斯分布假设的方法仍然需要对数据或模型具有一定的先验知识,可能在实际应用中难以满足.

贝叶斯框架从概率的角度对数据进行建模,其在参数辨识方面本身就具有对噪声和离群值鲁棒的效果.基于贝叶斯推理,Scardapane等人[46]提出了一种贝叶斯随机向量函数连接网络用于鲁棒数据建模. Zhao等人[47]假设测量噪声符合学生-t分布,在含有时变及时间延迟的ARX模型上通过变分贝叶斯推断方法来实现模型参数的鲁棒估计.通过考虑数据中蕴含的概率分布,变分贝叶斯推断的方法可以感知模型参数中的不确定性及时间延迟[48].然而,贝叶斯优化方法在大规模时间序列建模时,因其计算复杂度较高,会遇到计算瓶颈,因此在大规模数据建模中需要新的近似推断方法[49].

在深度学习领域,通常在训练过程中加入噪声,增强模型的鲁棒性,防止模型过拟合,加快模型的收敛速度[50-54].仿真实验及理论分析表明,向训练过程中施加噪声可以起到与Tikhonov正则化相同的效果.同时,这种方法可以看作是一种计算复杂度更低的贝叶斯方法[55]. Novak等人[56]通过引入神经网络的输入—输出Jacobian矩阵的范数,提供了一种经验性的证明,表明在训练过程向输入数据的流形附近施加扰动会使神经网络模型对噪声更加鲁棒.在未来,随着深度学习方法在混沌时间序列建模的研究的逐渐深入,这种施加噪声的方式可能会变得更加实用.

3 非平稳混沌时间序列预测非平稳时间序列是指均值和方差随时间具有系统性变化的时间序列.传统的时间序列统计建模方法以时间序列平稳为前提条件,如果时间序列是非平稳的,则需要对原始时间序列进行平稳化处理之后才能够建模.现代的以神经网络、支持向量机为代表的机器学习方法同样也要求训练数据和测试数据符合独立同分布假设.

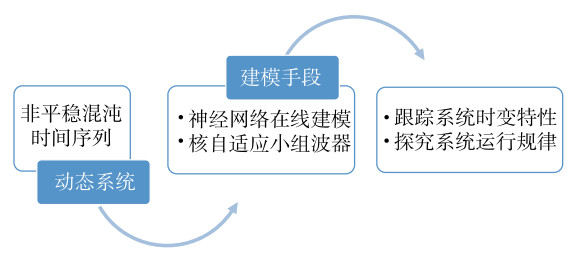

然而,在大数据的时代,数据流的产生源源不断.同时,受外界扰动及系统参数变化的影响,传感器采样数据很难满足独立同分布假设.因此,非平稳混沌时间序列数据建模对跟踪系统时变特性具有重要作用.针对非平稳时间序列,大多数学者采用在线学习方法来对复杂系统建模,模型随着数据流的输入实时更新,通过参数的在线学习,跟踪系统状态.本节按照图 4所示的结构展开,主要关注神经网络在线建模、核自适应滤波器等方法在非平稳数据的在线建模中的应用.

|

| 图 4 非平稳混沌时间序列预测示意图 Fig.4 Schematic diagram of non-stationary chaotic time series prediction |

根据数据实时更新神经网络的参数,可以实现混沌时间序列的在线预测.韩敏等人[57]提出了一种基于在线求解回声状态网络输出权值的非平稳混沌时间序列预测方法.在输出权值中增加稀疏约束,利用截断梯度算法求解,在保证不损失预测精度的同时,模型的稀疏性也得到了一定程度提高. Wang等人[58]提出了一种在线核极限学习机模型,在原始极限学习机模型中引入核矩阵,在高维空间中逼近时间序列动态变化趋势,同时通过在线迭代求解获得系统的最新状态.该方法在非平稳Mackey-Glass时间序列及股票时间序列预测上获得了较好的效果.韩敏等人[59]提出了改进的回声状态网络在线预测模型,该方法使用卡尔曼滤波算法估计回声状态网络输出层权值. Wang等人[60]提出了一种改进Levenberg-Marquardt算法求解单隐层前馈神经网络输出权值的在线预测模型,通过迭代求解Hessian矩阵降低计算复杂度,在时间序列在线预测任务中取得了较好的效果. Han等人[61]采用平方根容积法卡尔曼滤波算法在线调整回升状态网络的储备池输出权值,精度达到三阶以上,并且该模型的收敛速度更快,稳态误差更小.同时该方法在滤波算法中加入异常值检测,可消除非平稳时间序列中的异常值对后续时间序列预测任务的影响.

Castro-Neto等人[62]提出了一种基于监督统计学习的在线支持向量回归(OL-SVR)方法,用于预测典型和非典型条件下的短期高速公路的交通流量.结果表明,该方法在非典型交通条件下的预测表现更佳. Guo等人[63]提出了一种递归神经网络(RNN)自适应梯度学习方法,用于预测存在异常值和变化点的时间流序列.该方法根据时间序列的局部特征和数据的分布特性,自动加权新观测值损失的梯度.将加权梯度引入到RNN模型的在线SGD中,对离群点采用降权梯度,对变化点采用全梯度,从而逐步学习时间流序列,以适应不断变化的模式以及抵抗异常值. Wang等人[64]建立了一种在线支持向量机(OL-SVM)模型,对香港市区空气污染物浓度进行了预测.与传统的SVM模型相比,OL-SVM不仅能连续接收数据,动态确定最优预测模型,而且具有良好的预测性能. Duchi等人[65]提出了一种新的次梯度方法,它动态地结合了早期迭代中观察数据的几何知识,以执行更多的基于梯度的信息学习.采用负矩阵分解的降维方式来实现在线稀疏学习,具有更加全面的预测性. Mairal等人[66]提出使用基于随机近似的新在线优化算法来解决字典学习,采用非负矩阵分解和稀疏主成分分析适应特定数据,并且该算法可以扩展到具有数百万个训练样本的大数据集,并自然地扩展到各种矩阵分解公式,使其广泛应用于在线预测问题.

3.2 核自适应滤波器核自适应滤波器(kernel adaptive filters,KAF)是一种在线追踪非线性信号的动态自适应模型,其中最具代表性的在线学习方法是核递归最小二乘(kernel recursive least square,KRLS)算法和核最小均方(kernel least mean squares,KLMS)算法. KRLS将核函数引入递归最小二乘方法中,通过动态矩阵求逆公式在线更新网络权值,在时间序列在线预测研究中引起了广泛的关注.当输入数据样本量较少时,其计算较为简单,模型具有较低的计算复杂度,并能够以递归形式在线更新.然而,随着数据量的增加和预测环境的复杂化,模型的内存占用量增加,对核矩阵求逆的计算复杂度也会显著增加,模型的自适应跟踪能力降低,从而在计算效率和适应时变环境方面都出现困难. KLMS是指在RKHS中进行的自适应过程,它结合核技巧和最小均方算法来实现样本到样本的更新.该过程在增加较少运算量的情况下可加快模型收敛速度,可较快跟踪到模型参数,减少训练序列的预处理时间,从而提高自适应参数的利用效率.针对这些问题,学者们主要从限制核矩阵维度、降低核矩阵求逆的计算复杂度方面入手进行研究.

Chen等人[67]使用量化策略来代替稀疏准则,提出了一种量化核最小均方模型.其基本思想是矢量量化原始数据并以此压缩输入或特征空间,以遏制自适应滤波器中核矩阵的增长.矢量量化是使用“冗余”数据来更新最接近中心的系数,该过程在短期的混沌时间序列预测中取得了较好的效果. Zhao等人[68]首次提出具有单反馈结构的核最小均方(SF-KLMS)算法.在SF-KLMS中只有一个延迟输出被用于以循环方式更新权重,过去信息的使用显著地加快了收敛速度. Liu等人[69]提出了基于随机特征网络的核最小均方(KLMS-RFN)算法.它的随机特征映射变换是将样本输入到相对低维的特征空间,其中变换后的样本近似等于在特征空间中使用一个移位不变核.该过程克服了不断增长的权重网络的约束,同时更新样本以跟踪输入的特征变化,最终在非平稳环境中得到较好的预测结果.

Song等人[70]提出了一种鲁棒递归核在线学习算法,在递归损失函数中自动地平衡正则项,通过稀疏性达到提高泛化性能的效果. Han等人[71]将近似线性依赖准则、动态调整和相干性标准与量化核递归最小二乘方法相结合,提出了一种用于多变量混沌时间序列在线预测的自适应归一化稀疏量化核递归最小二乘算法.这种方法适用于具有实时动态变化的复杂系统建模,它不但能够有效地提高计算效率,还能够提升模型的预测精度,并能在时变环境中自适应调整学习权重,在多元混沌时间序列预测中展现出较好的预测的精度和效率. Van Vaerenbergh等人[72]提出了一种基于核的快速自适应非线性滤波递归最小二乘(SW-KRLS)算法.该方法结合了滑动时间窗口方法和L2范数正则化.滑动时间窗用于确定内核矩阵维数,该策略始终保持字典的维度不变,L2范数正则化则是改进了模型的泛化能力. Liu等人[73]提出了扩展核递归最小二乘(EX-KRLS)方法.该方法使用卡尔曼滤波器和状态转移策略来学习内核,并通过最新的样本数据完成在线学习过程. Chen等人[74]将矢量量化(VQ)应用于KRLS模型,提出了量化核递归最小二乘(QKRLS)算法.其基本思想是使用较小数据集来表示整个输入数据承载的信息,从而提高预测精度. VQ具有计算简单、量化的大小比较容易选择和冗余数据可以很容易被利用的优势.

在非平稳混沌时间序列的在线建模中,目前学者主要考虑单一变量的非平稳在线建模研究.然而,随着传感器网络规模的增长,针对多变量的非平稳时间序列在线建模十分有必要[75].如何探究多元变量之间的非平稳变化趋势及其影响关系是一个值得深入探讨的话题.

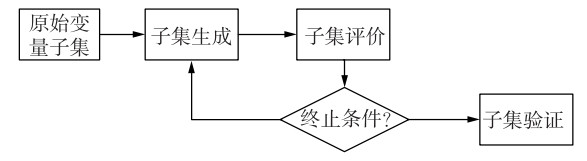

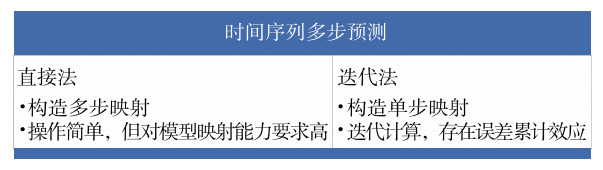

4 混沌时间序列中长期预测混沌系统的演化受系统初始状态影响极大.因此,在可预测范围内尽可能地实现最大限度的中长期预测是复杂系统建模中重要的问题[76].时间序列的多步预测共有两种策略:直接法和迭代法.时间序列多步预测的策略如图 5所示.直接法通过构造一个输入与多步之后的输出之间的函数映射,一次性地完成长期时间序列预测.其思想简单、易于实现,但是直接法需要较复杂的映射结构,对模型设计提出了较大的挑战.迭代法每次只预测一步之后的时间序列值,然后将预测值作为已知,迭代预测下一步.迭代策略对模型要求较低,但是在迭代过程中,预测误差也被输入到模型中,容易造成误差累积,导致中长期预测精度下降.

|

| 图 5 时间序列多步预测策略 Fig.5 Strategies for multi-step time series prediction |

Han等人[77]提出了一种基于直接预测策略的多分支时间延迟神经网络,用于混沌时间序列中长期预测.该方法将混沌系统的相空间重构理论与多分支时间延迟神经网络相结合,以网络节点和分支来代表相空间重构参数,更符合实际复杂系统状态变量的演化规律.同时多分支时间延迟神经网络可以同时跟踪当前状态的多条邻近轨迹,削弱预测步长对预测精度的影响. Mu等人[78]通过车辆行驶数据和气象数据的异源延迟嵌入,以及正交局部保持投影来降低输入数据维度,提取时间序列数据的长期变化规律,通过直接预测策略在能量消耗的长期预测任务中取得了较好的效果. Yi等人[76]提出了一种深度分布式融合网络模型,首先分别使用单独的深度网络对气候、天气、其它污染物以及空气质量进行建模,然后基于直接预测策略通过加权融合来进行48小时之后的北京空气质量预测. Zhao等人[79]提出了一种基于直接预测策略的能量流长期预测方法,在中国某钢厂的真实工业能源数据的合理调度与配置中起到了重要的意义. Deng等人[80]受生物学相关学习概念的启发,在深度学习(DL)和强化学习(RL)的框架下,提出一种用于实时金融信号检测和交易的递归深度神经网络.在该框架下,DL部分自动感知信息特征学习的动态市场条件.然后,RL模块与深层表示交互,做出交易决策,在未知的环境中积累最终的回报.通过两种框架构造了一个深度强化学习器,用于股票长期预测,并实现自动交易.

4.2 基于迭代策略的中长期时间序列预测Belayneh等人[81]认为迭代预测策略比直接预测策略效果更好,其使用ARIMA模型、小波—支持向量回归以及小波-神经网络,通过迭代策略来预测埃塞俄比亚阿瓦什河流域的标准化降水指数,以实现长时间范围的干旱预测. Herrera等人[82]基于迭代预测策略,使用T-S模糊模型和最小二乘支持向量机来进行时间序列长期预测任务. Menezes等人[83]基于迭代预测策略,将NARX网络用于交通流时间序列的长期预测中,结果表明,该方法的预测性能始终优于基于神经网络的预测器,如TDNN和Elman体系结构. Sorjamaa等人[84]提出了一种时间序列长期预测的全局方法,该方法结合了直接预测策略和复杂的输入选择准则k近邻逼近法(k-NN)、互信息(MI)和非参数噪声估计,提出了一种结合前向选择、后向消除(或剪枝)和前向后向选择的全局输入选择策略.该方法已成功地应用于波兰电力负荷数据集的长时间预测. Grigorievskiy等人[85]提出了一种最优剪枝极限学习机模型,用于时间序列的长期预测,通过比较分析直接预测、迭代预测、直接-迭代预测三种策略,发现无论是哪种策略都不能保证长期预测结果最好.如何构造一种复杂系统建模机制,实现复杂系统演化的中长期预测,对预防动态系统的大规模灾变非常有意义,相关工作仍然需要进行细致的研究. Ji等人[86]将ARMA和时延神经网络(TDNN)结合,提出一种新的混合预测模型.并将该混合模型用于预测太阳辐射时程预测.新的混合模型采用ARMA模型预测时间序列的线性分量,TDNN模型预测非线性分量.结果表面,该模型同时具有ARMA和TDNN的优点,预测精度得到了提升.

5 讨论与未来研究方向针对混沌时间序列的分析与预测,前面详细介绍了多元混沌时间序列的降维方法、含噪声混沌时间序列预测、非平稳混沌时间序列预测以及混沌时间序列中长期预测. 图 6展示了混沌时间序列预测的基本步骤.本文总结的方法为复杂系统建模提供了完整的技术手段,具有广阔的应用前景.

|

| 图 6 混沌时间序列预测示意图 Fig.6 Schematic diagram of chaotic time series prediction |

随着传感器的普及使用及计算机信息技术的高速发展,人们往往能够通过更加复杂的高维、大规模数据来研究工业、气象、医学等复杂系统的机理及演化规律.但这也对数据的预处理方式提出了更高的要求.常用的时间序列降维方法包括变量选择和特征提取.当系统冗余程度不高、数据维度和规模不大,可以采用以下方法进行变量选择:1)采用相关性度量的变量选择方法,如相关系数、互信息等方法;2)基于惩罚函数的变量选择方法,如正则化方法等;3)通过构建评价模型对所有变量进行重要性打分,例如随机森林和逻辑回归等方法.而面对数据维度较高、规模较大的复杂系统,采用特征提取方法具有更好的降维效果.代表性的特征提取方法主要有以PCA为代表的线性降维方法、基于流形学习的非线性降维方法.上述方法在大多数时间序列建模问题中取得了理想的结果,然而复杂系统的观测变量之间具有直接或间接的关联关系,分析出变量之间的直接影响关系,进而推断系统的内部结构与运行规律,能够为建立精确的预测模型提供便利.因此,Granger因果分析、基于信息理论的因果分析等因果模型已经成为时间序列预处理的重要手段,具有很好的研究前景.

在混沌时间序列建模过程中,噪声往往会影响模型的准确性.为了降低噪声对模型的影响,学者们从数据去噪、含噪声时间序列的鲁棒建模等方面展开研究.去噪方法能够有效降低混沌时间序列的噪声和异常值干扰,提高预测模型的精度,但是可能会导致混沌系统的演化信息丢失.因此,更多学者研究鲁棒建模方法,主要包含三类方法:鲁棒损失函数建模、数据分布假设建模以及基于贝叶斯推理的建模方法.鲁棒损失函数从模型训练的角度来避免噪声对模型的不利影响,在一定程度上提高模型的抗噪能力.数据分布假设建模方法考虑多种长尾数据分布,代替数据的高斯分布假设,提高模型的泛化能力和鲁棒性,需要一定的先验知识作为指导.基于贝叶斯推理的建模方法利用概率密度函数在参数辨识中的鲁棒性,但面对大规模数据时,其计算复杂度很高,具有一定的局限性.此外,在深度学习领域,噪声有着其两面性.在监督学习中,训练数据对应的标签质量对于学习效果至关重要.如果在模型训练过程中加入适当的噪声,利用含噪声的标签训练模型往往能够增加模型的鲁棒性能.但过多噪声的加入,又会影响模型的精度.因此,训练标签的含噪声程度、以及噪声类型如何确定,需要进一步做深入研究.

由于大多数混沌时间序列都表现出非线性、非平稳、复杂难预测的特点,复杂系统中包含着许多与系统演化机理密切相关的有用信息,而且随着时间的推移,其信息量也在不断扩充、增加,所以对其进行合理的预测具有十分重要的意义.目前常用的时间序列在线预测方法主要是神经网络在线建模方法和核自适应滤波器方法.其中,神经网络具有自学习能力、联想存储功能和高效寻找优化解的能力,可以很好地处理复杂的非线性信号.另外,KAF具有在线实时处理非平稳信号的能力,目前已经广泛的应用于在线时间序列预测.虽然在线形式可以实时的处理时间序列信号,但就处理大规模复杂、非线性、非平稳数据方面存在较大问题.所以,有学者已经在KAF的基础上添加过滤窗、迭代误差补偿、最大相关熵、组合核函数、序贯深度学习、顺序优化方法、笛卡尔积度量分布式学习等深度建模形式对复杂时间序列进行预测.同时,也有学者在贝叶斯框架建立起在线“遗忘”机制,从而很好地处理带噪的脑电信号,衰落和突变信道的跟踪.因此,基于KAF的多种深度建模方法具有广阔的应用前景,比如在现有模型的基础上添加滑动时间窗、近似线性依赖准则等在线稀疏机制来进一步扩展它的应用性能也具有重要的研究意义.综上,基于改进KAF的预测方法已经成为复杂非平稳时间序列在线预测的重要预测手段,在实时监测方面具有重要的研究前景.

在可预测范围内尽可能实现混沌时间序列的多步预测是复杂系统建模的关键问题.根据第4节研究内容可知,时间序列的多步预测策略主要包括直接法和迭代法两类.基于两种基本预测策略,学者提出了更加复杂的多步预测策略,例如直接—递归(DirRec)策略、多输入—多输出(MIMO)策略、直接—多输出(DIRMO)策略等.其中,多输出策略能够避免直接法的条件独立性假设,并且消除迭代法的误差累积问题,是一种很有研究前景的预测策略.根据特定的复杂系统和预测问题,选择合理的、性能最好的预测策略是建模中需要重点考虑的问题之一.

综上所述,随着传感器网络技术的高速发展,复杂、大规模、高维数据已经广泛存在于各个领域的复杂系统中.随着数据维度和规模的不断增长,传统的建模手段难以满足大规模复杂系统的建模要求.因此,以深度学习为代表的新兴手段成为复杂系统建模的新趋势.我们总结了以下三方面新的研究趋势:

1) 基于深度学习的时间序列建模

近年来,随着深度学习方法在语音识别、图像处理等领域快速应用发展也为混沌时间序列建模带来新的机遇与挑战.深度学习方法在特征提取领域具有良好的应用前景,它能够处理高维的输入数据,并自动提取数据表征[87].例如:卷积神经网络可以通过卷积核将高维图像数据降维,通过多次卷积核池化操作来提取图像中的语义信息;长短时记忆神经网络及门控神经网络可以对语音及文本数据进行较好的建模,通过引入注意力机制,在文本翻译及语音识别等任务中取得了重大突破.

目前已经有很多学者将深度学习应用于时间序列预测中. Yang等人[88]提出了一种经过结构优化的堆栈自编码Levenberg-Marquardt模型,用于英国高速交通流量预测中. Koesdwiady等人[89]考虑天气对人们出行的影响,通过深信度网络对天气和交通流量之间的关联关系建模,获得了较好的交通流预测精度. Li等人[90]将时空深度学习模型用于空气质量预测任务中,取得了比传统方法更好的精度. Ding等人[91]通过深度卷积神经网络模型提取媒体的文本特征,结合股票指数序列,预测因突发事件影响的金融市场动态. Zhang等人[92-93]通过深度卷积神经网络和深度残差网络对城市网格区域的人口流动时空数据进行建模,挖掘城市内人口迁移背后的动态模式. Yi等人[76]构造了一种融合多种深度学习的模型,自动提取异源数据的嵌入表征,然后使用深度学习手段对未来空气质量数据进行预测建模.基于深度学习的方法可以自动提取复杂系统采样数据背后蕴含的模式信息[87],相比于传统神经网络方法,对混沌时间序列数据的动态特性挖掘更加深入.

然而,当前的时间序列深度学习方法大多借鉴图像处理、自然语言处理等领域的手段,如何将复杂动态系统中时间序列的领域知识融合到深度学习中仍然值得研究.随着海量高维时间序列数据的到来,非常需要新的处理高维混沌时间序列的手段.同时,在使用深度学习方法对复杂系统建模过程中,模型的可解释性也是一个值得研究的重要问题.

2) 基于多任务学习的时间序列建模

多元混沌时间序列预测目前是复杂系统建模的主流研究手段.然而,大多数现有的多元混沌时间序列预测方法从映射建模的角度考虑,仅仅构造了多元变量针对单一变量或多元变量的映射关系,未能充分挖掘多元变量之间的结构信息及耦合影响.

多任务学习是由Caruana[94]最初于1997年提出的思想,经过20多年的发展,已经被多个领域的学者认可,成为一种提高模型泛化性能、精简模型的重要手段.近年来,有学者提出将多任务学习用于复杂动态系统的时间序列建模中[75, 95-103]. Durichen等人[95]提出了一种多任务高斯过程模型,用于同时对多个具有关联关系的医疗时间序列数据进行建模.仿真结果表明,即使采样数据的频率不同,所提模型可以同时挖掘多元时间序列的关联关系. Papagiannopoulou等人[96]在格兰杰因果分析的框架下,通过多任务学习的思想,构造了一种全球气象时空数据分析方法,用于分析气候与植被之间的动态关系.多任务学习思想的引入使得格兰杰因果分析的鲁棒性更强,并且通过多任务学习所获得的低维表征可以加强模型的因果推断能力. Goncalves等人[97]提出使用分层多任务学习来对全球气候数据进行建模.在分层多任务学习中,整体任务被分割成多个子任务,然后通过Group-lasso正则化来计算多个子任务与高级任务之间的参数.这种方式为探索给定地点的不同气候变量之间的关系提供了较大便利. Zhen等人[98]提出多目标稀疏潜在回归方法,用于多元时间序列预测任务中.在模型中,使用核方法来映射输入-输出数据,并使用L2,1范数稀疏约束选择与目标变量相关的特征. Xu等人[75]提出一个在线多任务学习框架,用于时间序列的集成预测中,通过“重启在线学习”的方式估计组合成员的最佳预测权值,在北美12个主要河流流域的季节性土壤水分预测中取得了较好的效果. Li等人[99]提出了一种多层高斯过程多任务学习模型,使用高斯过程的协方差矩阵来学习多个任务之间的共享特征.

传统的时间序列分析手段难以探究复杂系统中多元变量之间的相互影响关系,而时间序列的多任务学习则在建模初就考虑多元变量之间的影响和耦合关系,可以描述复杂系统内部的演化规律,为复杂系统建模带来了极大便利.因此,基于多任务学习的高维数据建模可能会成为未来的大规模复杂系统建模的一个趋势.

3) 基于迁移学习的时间序列建模

随着人类社会活动范围的扩展,对大气的监测可能向新的地点迁移.在工业生产中,某一系统的刚刚启动,尚未获得足够的观测数据可以建模,但是已经有足够的类似的复杂系统采样数据.此时,我们可以先使用源领域的采样数据来建立以数据驱动的动态系统模型.然后,使用一系列领域自适应手段,将建立好的复杂系统模型迁移到新的、观测数据不足的复杂系统中,完成动态系统演化信息的迁移学习任务[100].目前,已经有学者对时间序列的迁移学习采取了尝试,取得了一定的进展[101-107]. Laptev等人[105]通过在网络中引入一个重新设计的损失函数,将在大规模数据中预训练过的长短时记忆网络(long short-term memory,LSTM)应用于一个全新的数据集上,取得了比其它基于深度学习方法更好的效果. Hu等人[104]使用旧的风电厂运行数据对深度神经网络进行建模,然后将建立好的模型迁移到新建的风电厂中,仿真结果证明经过迁移学习的模型对风速的预测效果明显优于传统的建模方法. Fawaz等人[106]对UCI数据库中的85组时间序列数据进行一一对应的迁移学习训练,共生成了7 140个不同的深度学习模型以验证迁移学习在时间序列预测中的效果.仿真结果证明,在大部分两两匹配的迁移学习任务中取得了积极的效果.

在未来的动态系统建模中,数据不均衡现象可能会非常严重.比如,某工厂运行多年,具有大量传感器采样数据.但是,新建工厂的运行数据少,难以有针对性地建立复杂系统模型.此时,迁移学习可能是一种较好的处理手段.然而,在迁移学习过程中,源域的数据选取对目标域的数据选取具有较大的影响,虽然此问题在图像识别以及自然语言处理等领域已经有了较大进展,但是针对复杂系统中混沌时间序列的领域自适应问题仍然值得深入研究.

6 结论本文简要介绍了复杂系统中混沌时间序列预测的几个主要研究问题,并对几个主要研究问题进行了综述、对比分析与展望.在未来研究中,随着对复杂动态系统研究的不断深入,时间序列建模需要更能够描述复杂系统动态的手段,基于多任务学习、迁移学习以及深度学习的建模方法,在未来的跨领域多元混沌时间序列的中长期建模任务中必将起着重要的作用.

| [1] | Esling P, Agon C. Time-series data mining[J]. ACM Computing Surveys, 2012, 45(1): 12. |

| [2] | Qiu T, Zhao A Y, Xia F, et al. ROSE:Robustness strategy for scale-free wireless sensor networks[J]. IEEE/ACM Transactions on Networking, 2017, 25(5): 2944–2959. DOI:10.1109/TNET.2017.2713530 |

| [3] | Han M, Ren W J, Xu M L, et al. Nonuniform state space reconstruction for multivariate chaotic time series[J]. IEEE Transactions on Cybernetics, 2019, 49(5): 1885–1895. DOI:10.1109/TCYB.2018.2816657 |

| [4] | Cellucci C J, Albano A M, Rapp P E. Comparative study of embedding methods[J]. Physical Review E, 2003, 67(6): 066210. DOI:10.1103/PhysRevE.67.066210 |

| [5] | Molkov Y I, Mukhin D N, Loskutov E M, et al. Using the minimum description length principle for global reconstruction of dynamic systems from noisy time series[J]. Physical Review E, 2009, 80(4): 046207. DOI:10.1103/PhysRevE.80.046207 |

| [6] | Fraser A M, Swinney H L. Independent coordinates for strange attractors from mutual information[J]. Physical Review A, 1986, 33(2): 1134. DOI:10.1103/PhysRevA.33.1134 |

| [7] | Kim H S, Eykholt R, Salas J D. Nonlinear dynamics, delay times, and embedding windows[J]. Physica D:Nonlinear Phenomena, 1999, 127(1/2): 48–60. |

| [8] | Han M, Wang Y. Analysis and modeling of multivariate chaotic time series based on neural network[J]. Expert Systems with Applications, 2009, 36(2): 1280–1290. DOI:10.1016/j.eswa.2007.11.057 |

| [9] | Kugiumtzis D. Direct-coupling information measure from nonuniform embedding[J]. Physical Review E, 2013, 87(6): 062918. DOI:10.1103/PhysRevE.87.062918 |

| [10] | Gui J, Sun Z A, Ji S W, et al. Feature selection based on structured sparsity:A comprehensive study[J]. IEEE Transactions on Neural Networks and Learning Systems, 2017, 28(7): 1490–1507. DOI:10.1109/TNNLS.2016.2551724 |

| [11] | Judd K, Mees A. Embedding as a modeling problem[J]. Physica D:Nonlinear Phenomena, 1998, 120(3/4): 273–286. |

| [12] | Faes L, Nollo G, Porta A. Information-based detection of nonlinear Granger causality in multivariate processes via a nonuniform embedding technique[J]. Physical Review E, 2011, 83(5): 051112. DOI:10.1103/PhysRevE.83.051112 |

| [13] | Shen M, Chen W N, Zhang J, et al. Optimal selection of parameters for nonuniform embedding of chaotic time series using ant colony optimization[J]. IEEE Transactions on Cybernetics, 2013, 43(2): 790–802. DOI:10.1109/TSMCB.2012.2219859 |

| [14] | Vlachos I, Kugiumtzis D. Nonuniform state-space reconstruction and coupling detection[J]. Physical Review E, 2010, 82(1): 016207. DOI:10.1103/PhysRevE.82.016207 |

| [15] | Erem B, Orellana R M, Hyde D E, et al. Extensions to a manifold learning framework for time-series analysis on dynamic manifolds in bioelectric signals[J]. Physical Review E, 2016, 93(4): 042218. DOI:10.1103/PhysRevE.93.042218 |

| [16] | Längkvist M, Karlsson L, Loutfi A. A review of unsupervised feature learning and deep learning for time-series modeling[J]. Pattern Recognition Letters, 2014, 42: 11–24. DOI:10.1016/j.patrec.2014.01.008 |

| [17] | Stulp F, Sigaud O. Many regression algorithms, one unified model:A review[J]. Neural Networks, 2015, 69: 60–79. DOI:10.1016/j.neunet.2015.05.005 |

| [18] | Li L, Su X N, Zhang Y, et al. Trend modeling for traffic time series analysis:An integrated study[J]. IEEE Transactions on Intelligent Transportation Systems, 2015, 16(6): 3430–3439. DOI:10.1109/TITS.2015.2457240 |

| [19] | Han M, Zhong K, Qiu T, et al. Interval type-2 fuzzy neural networks for chaotic time series prediction:A concise overview[J]. IEEE Transactions on Cybernetics, 2019, 49(7): 2720–2731. DOI:10.1109/TCYB.2018.2834356 |

| [20] | Liu H, Yu L. Toward integrating feature selection algorithms for classification and clustering[J]. IEEE Transactions on Knowledge and Data Engineering, 2005(4): 491–502. |

| [21] | Guyon I, Elisseeff A. An introduction to variable and feature selection[J]. Journal of Machine Learning Research, 2003, 3: 1157–1182. |

| [22] | Yoon H, Yang K, Shahabi C. Feature subset selection and feature ranking for multivariate time series[J]. IEEE Transactions on Knowledge and Data Engineering, 2005, 17(9): 1186–1198. DOI:10.1109/TKDE.2005.144 |

| [23] | Peng H C, Long F H, Ding C. Feature selection based on mutual information:criteria of max-dependency, max-relevance, and min-redundancy[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2005, 27(8): 1226–1238. DOI:10.1109/TPAMI.2005.159 |

| [24] |

韩敏, 梁志平.

一种基于k-近邻互信息变化率的输入变量选择方法[J]. 控制与决策, 2012, 27(6): 949–952.

Han M, Liang Z P. An input variables selection method based on k-nearest neighbors mutual information[J]. Control and Decision, 2012, 27(6): 949–952. |

| [25] | Han M, Ren W J, Liu X X. Joint mutual information-based input variable selection for multivariate time series modeling[J]. Engineering Applications of Artificial Intelligence, 2015, 37: 250–257. DOI:10.1016/j.engappai.2014.08.011 |

| [26] | Han M, Ren W J. Global mutual information-based feature selection approach using single-objective and multi-objective optimization[J]. Neurocomputing, 2015, 168: 47–54. DOI:10.1016/j.neucom.2015.06.016 |

| [27] |

韩敏, 张瑞全, 许美玲.

一种基于改进灰色关联分析的变量选择算法[J]. 控制与决策, 2017, 32(9): 1647–1652.

Han M, Zhang R Q, Xu M L. A variable selection algorithm based on improved grey relational analysis[J]. Control and Decision, 2017, 32(9): 1647–1652. |

| [28] | Guyon I, Weston J, Barnhill S, et al. Gene selection for cancer classification using support vector machines[J]. Machine learning, 2002, 46(1/2/3): 389–422. |

| [29] | Han M, Zhang R Q, Xu M L. Multivariate chaotic time series prediction based on ELM-PLSR and hybrid variable selection algorithm[J]. Neural Processing Letters, 2017, 46(2): 705–717. DOI:10.1007/s11063-017-9616-4 |

| [30] |

Shi Y, Miao J Y, Wang Z Y, et al.

Feature Selection With  Regularization[J]. IEEE Transactions on Neural Networks and Learning Systems, 2018, 29(10): 4967–4982.

DOI:10.1109/TNNLS.2017.2785403 Regularization[J]. IEEE Transactions on Neural Networks and Learning Systems, 2018, 29(10): 4967–4982.

DOI:10.1109/TNNLS.2017.2785403 |

| [31] | Zhang P C, Jia Y Y, Gao J, et al. Short-term rainfall forecasting using multi-layer perceptron[J]. IEEE Transactions on Big Data, to be published. https://www.researchgate.net/publication/327759811_Short-term_Rainfall_Forecasting_Using_Multi-layer_Perceptron |

| [32] | Liu W, Zhang H, Tao D, et al. Large-scale paralleled sparse principal component analysis[J]. Multimedia Tools and Applications, 2016, 75(3): 1481–1493. DOI:10.1007/s11042-014-2004-4 |

| [33] | Yi S Y, Lai Z H, He Z Y, et al. Joint sparse principal component analysis[J]. Pattern Recognition, 2017, 61: 524–536. DOI:10.1016/j.patcog.2016.08.025 |

| [34] | Zheng Y. Methodologies for cross-domain data fusion:An overview[J]. IEEE Transactions on Big Data, 2015, 1(1): 16–34. DOI:10.1109/TBDATA.2015.2465959 |

| [35] | Han M, Liu Y H, Xi J H, et al. Noise smoothing for nonlinear time series using wavelet soft threshold[J]. IEEE Signal Processing Letters, 2007, 14(1): 62–65. DOI:10.1109/LSP.2006.881518 |

| [36] |

韩敏, 刘玉花, 席剑辉, 等.

基于小波变换阈值决策的混沌信号去噪研究[J]. 信息与控制, 2005, 34(5): 543–547.

Han M, Liu Y H, Xi J H, et al. Chaotic signal denoising based on threshold selection of wavelet transform[J]. Information and Control, 2005, 34(5): 543–547. DOI:10.3969/j.issn.1002-0411.2005.05.007 |

| [37] |

席剑辉, 韩敏, 孙燕楠.

改进非线性局部平均算法的混沌去噪研究[J]. 系统工程与电子技术, 2005, 27(5): 799–802.

Xi J H, Han M, Sun Y N. Application of nonlinear local average algorithm in chaotic noise reduction[J]. Journal of System Engineering and Electronics, 2005, 27(5): 799–802. DOI:10.3321/j.issn:1001-506X.2005.05.012 |

| [38] | Xia Y S, Wang J. Robust regression estimation based on low-dimensional recurrent neural networks[J]. IEEE Transactions on Neural Networks and Learning Systems, 2018, 29(12): 5935–5946. DOI:10.1109/TNNLS.2018.2814824 |

| [39] | Lee C C, Chung P C, Tsai J R, et al. Robust radial basis function neural networks[J]. IEEE Transactions on Systems, Man, and Cybernetics, Part B (Cybernetics), 1999, 29(6): 674–685. DOI:10.1109/3477.809023 |

| [40] | Shi Z W, Han M. Support vector echo-state machine for chaotic time-series prediction[J]. IEEE Transactions on Neural Networks, 2007, 18(2): 359–372. DOI:10.1109/TNN.2006.885113 |

| [41] | Chen K, Lv Q, Lu Y, et al. Robust regularized extreme learning machine for regression using iteratively reweighted least squares[J]. Neurocomputing, 2017, 230: 345–358. DOI:10.1016/j.neucom.2016.12.029 |

| [42] | Lu X J, Ming L, Liu W B, et al. Probabilistic regularized extreme learning machine for robust modeling of noise data[J]. IEEE Transactions on Cybernetics, 2018, 48(8): 2368–2377. DOI:10.1109/TCYB.2017.2738060 |

| [43] | Vanhatalo J, Jylänki P, Vehtari A. Gaussian process regression with Student-t likelihood[C]//Advances in Neural Information Processing Systems. Vancouver, Canada: Curran Associates Inc, 2009: 1910-1918. https://www.researchgate.net/publication/285879149_Gaussian_process_regression_with_Student-t_likelihood |

| [44] | Li D C, Han M, Wang J. Chaotic time series prediction based on a novel robust echo state network[J]. IEEE Transactions on Neural Networks and Learning Systems, 2012, 23(5): 787–799. DOI:10.1109/TNNLS.2012.2188414 |

| [45] | Vukovi N, Miljkovi Z. Robust sequential learning of feedforward neural networks in the presence of heavy-tailed noise[J]. Neural Networks, 2015, 63: 31–47. DOI:10.1016/j.neunet.2014.11.001 |

| [46] | Scardapane S, Wang D H, Uncini A. Bayesian random vector functional-link networks for robust data modeling[J]. IEEE Transactions on Cybernetics, 2018, 48(7): 2049–2059. DOI:10.1109/TCYB.2017.2726143 |

| [47] | Zhao Y J, Fatehi A, Huang B. Robust estimation of ARX models with time varying time delays using variational Bayesian approach[J]. IEEE Transactions on Cybernetics, 2018, 48(2): 532–542. DOI:10.1109/TCYB.2016.2646059 |

| [48] | Khan S H, Hayat M, Porikli F. Regularization of deep neural networks with spectral dropout[J]. Neural Networks, 2019, 110: 82–90. DOI:10.1016/j.neunet.2018.09.009 |

| [49] | Zhu J, Chen J F, Hu W B, et al. Big learning with Bayesian methods[J]. National Science Review, 2017, 4(4): 627–651. DOI:10.1093/nsr/nwx044 |

| [50] | Wang D L, Chen J T. Supervised speech separation based on deep learning:An overview[J]. IEEE/ACM Transactions on Audio, Speech, and Language Processing, 2018, 26(10): 1702–1726. DOI:10.1109/TASLP.2018.2842159 |

| [51] | Bishop C M. Training with noise is equivalent to Tikhonov regularization[J]. Neural computation, 1995, 7(1): 108–116. DOI:10.1162/neco.1995.7.1.108 |

| [52] | Jim K C, Giles C L, Horne B G. An analysis of noise in recurrent neural networks:convergence and generalization[J]. IEEE Transactions on Neural Networks, 1996, 7(6): 1424–1438. DOI:10.1109/72.548170 |

| [53] | Audhkhasi K, Osoba O, Kosko B. Noise-enhanced convolutional neural networks[J]. Neural Networks, 2016, 78: 15–23. DOI:10.1016/j.neunet.2015.09.014 |

| [54] | Minai A A, Williams R D. Perturbation response in feedforward networks[J]. Neural Networks, 1994, 7(5): 783–796. DOI:10.1016/0893-6080(94)90100-7 |

| [55] | Gal Y, Ghahramani Z. Dropout as a Bayesian approximation: Representing model uncertainty in deep learning[C]//33rd International Conference on Machine Learning. New York, USA: ICML, 2016: 1050-1059. |

| [56] | Novak R, Bahri Y, Abolafia D A, et al. Sensitivity and generalization in neural networks: an empirical study[J]. arXiv preprint arXiv: 1802. 08760, 2018. https://www.researchgate.net/publication/323413834_Sensitivity_and_Generalization_in_Neural_Networks_an_Empirical_Study |

| [57] |

韩敏, 王新迎.

一种有效的储备池在线稀疏学习算法[J]. 自动化学报, 2011, 37(12): 1536–1540.

Han M, Wang X Y. An effective online sparse learning algorithm for echo state networks[J]. Acta Automatica Sinica, 2011, 37(12): 1536–1540. |

| [58] | Wang X Y, Han M. Online sequential extreme learning machine with kernels for nonstationary time series prediction[J]. Neurocomputing, 2014, 145: 90–97. DOI:10.1016/j.neucom.2014.05.068 |

| [59] |

韩敏, 王亚楠.

基于Kalman滤波的储备池多元时间序列在线预报器[J]. 自动化学报, 2010, 36(1): 169–173.

Han M, Wang Y N. Multivariate time series online predictor with Kalman filter trained reservoir[J]. Acta Automatica Sinica, 2010, 36(1): 169–173. |

| [60] | Wang X Y, Han M. Improved extreme learning machine for multivariate time series online sequential prediction[J]. Engineering Applications of Artificial Intelligence, 2015, 40: 28–36. DOI:10.1016/j.engappai.2014.12.013 |

| [61] | Han M, Xu M L, Liu X X, et al. Online multivariate time series prediction using SCKF-γESN model[J]. Neurocomputing, 2015, 147(1): 315–323. |

| [62] | Castro-Neto M, Jeong Y S, Jeong M K, et al. Online-SVR for short-term traffic flow prediction under typical and atypical traffic conditions[J]. Expert Systems with Applications, 2009, 36(3): 6164–6173. DOI:10.1016/j.eswa.2008.07.069 |

| [63] | Guo T, Xu Z, Yao X, et al. Robust online time series prediction with recurrent neural networks[C]//2016 IEEE International Conference on Data Science and Advanced Analytics (DSAA). Piscataway, NJ, USA: IEEE, 2016: 816-825. https://www.researchgate.net/publication/312421663_Robust_Online_Time_Series_Prediction_with_Recurrent_Neural_Networks |

| [64] | Wang W J, Men C Q, Lu W Z. Online prediction model based on support vector machine[J]. Neurocomputing, 2008, 71(4/5/6): 550–558. |

| [65] | Duchi J, Hazan E, Singer Y. Adaptive subgradient methods for online learning and stochastic optimization[J]. Journal of Machine Learning Research, 2011, 12: 2121–2159. |

| [66] | Mairal J, Bach F, Ponce J, et al. Online learning for matrix factorization and sparse coding[J]. Journal of Machine Learning Research, 2010, 11: 19–60. |

| [67] | Chen B D, Zhao S L, Zhu P P, et al. Quantized kernel least mean square algorithm[J]. IEEE Transactions on Neural Networks and Learning Systems, 2012, 23(1): 22–32. DOI:10.1109/TNNLS.2011.2178446 |

| [68] | Zhao J, Liao X F, Wang S Y, et al. Kernel least mean square with single feedback[J]. IEEE Signal Processing Letters, 2015, 22(7): 953–957. DOI:10.1109/LSP.2014.2377726 |

| [69] | Liu Y Q, Sun C, Jiang S D. A kernel least mean square algorithm based on randomized feature networks[J]. Applied Sciences, 2018, 8(3): 458. DOI:10.3390/app8030458 |

| [70] | Song Q, Zhao X, Fan H J, et al. Robust recurrent kernel online learning[J]. IEEE Transactions on Neural Networks and Learning Systems, 2017, 28(5): 1068–1081. DOI:10.1109/TNNLS.2016.2518223 |

| [71] | Han M, Zhang S H, Xu M L, et al. Multivariate chaotic time series online prediction based on improved kernel recursive least squares algorithm[J]. IEEE Transactions on Cybernetics, 2019, 49(4): 1160–1172. DOI:10.1109/TCYB.2018.2789686 |

| [72] | Van Vaerenbergh S, Via J, Santamaría I. A sliding-window kernel RLS algorithm and its application to nonlinear channel identification[C]//2006 IEEE International Conference on Acoustics Speech and Signal Processing Proceedings. Piscataway, NJ, USA: IEEE, 2006: 789-792. https://www.researchgate.net/publication/224642204_A_Sliding-Window_Kernel_RLS_Algorithm_and_Its_Application_to_Nonlinear_Channel_Identification |

| [73] | Liu W F, Park I, Wang Y W, et al. Extended kernel recursive least squares algorithm[J]. IEEE Transactions on Signal Processing, 2009, 57(10): 3801–3814. DOI:10.1109/TSP.2009.2022007 |

| [74] | Chen B D, Zhao S L, Zhu P P, et al. Quantized kernel recursive least squares algorithm[J]. IEEE Transactions on Neural Networks and Learning Systems, 2013, 24(9): 1484–1491. DOI:10.1109/TNNLS.2013.2258936 |

| [75] | Xu J P, Tan P N, Zhou J Y, et al. Online multi-task learning framework for ensemble forecasting[J]. IEEE Transactions on Knowledge and Data Engineering, 2017, 29(6): 1268–1280. DOI:10.1109/TKDE.2017.2662006 |

| [76] | Yi X W, Zhang J B, Wang Z Y, et al. Deep distributed fusion network for air quality prediction[C]//Proceedings of SIGKDD. London, UK: ACM, 2018, 965-973. |

| [77] | Han M, Xi J H, Xu S G, et al. Prediction of chaotic time series based on the recurrent predictor neural network[J]. IEEE Transactions on Signal Processing, 2004, 52(12): 3409–3416. DOI:10.1109/TSP.2004.837418 |

| [78] | Mu T T, Jiang J M, Wang Y. Heterogeneous delay embedding for travel time and energy cost prediction via regression analysis[J]. IEEE Transactions on Intelligent Transportation Systems, 2013, 14(1): 214–224. DOI:10.1109/TITS.2012.2210419 |

| [79] | Zhao J, Han Z Y, Pedrycz W, et al. Granular model of long-term prediction for energy system in steel industry[J]. IEEE Transactions on Cybernetics, 2016, 46(2): 388–400. DOI:10.1109/TCYB.2015.2445918 |

| [80] | Deng Y, Bao F, Kong Y Y, et al. Deep direct reinforcement learning for financial signal representation and trading[J]. IEEE Transactions on Neural Networks and Learning Systems, 2017, 28(3): 653–664. DOI:10.1109/TNNLS.2016.2522401 |

| [81] | Belayneh A, Adamowski J, Khalil B, et al. Long-term SPI drought forecasting in the Awash River Basin in Ethiopia using wavelet neural network and wavelet support vector regression models[J]. Journal of Hydrology, 2014, 508: 418–429. DOI:10.1016/j.jhydrol.2013.10.052 |

| [82] | Herrera L J, Pomares H, Rojas I, et al. Recursive prediction for long term time series forecasting using advanced models[J]. Neurocomputing, 2007, 70(16/17/18): 2870–2880. |

| [83] | Menezes Jr J M P, Barreto G A. Long-term time series prediction with the NARX network:an empirical evaluation[J]. Neurocomputing, 2008, 71(16/17/18): 3335–3343. |

| [84] | Sorjamaa A, Hao J, Reyhani N, et al. Methodology for long-term prediction of time series[J]. Neurocomputing, 2007, 70(16/17/18): 2861–2869. |

| [85] | Grigorievskiy A, Miche Y, Ventelä A M, et al. Long-term time series prediction using OP-ELM[J]. Neural Networks, 2014, 51: 50–56. DOI:10.1016/j.neunet.2013.12.002 |

| [86] | Ji W, Chee C K. Prediction of hourly solar radiation using a novel hybrid model of ARMA and TDNN[J]. Solar Energy, 2011, 85(5): 808–817. DOI:10.1016/j.solener.2011.01.013 |

| [87] | Bengio Y, Courville A, Vincent P. Representation learning:A review and new perspectives[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2013, 35(8): 1798–1828. DOI:10.1109/TPAMI.2013.50 |

| [88] | Yang H F, Dillon T S, Chen Y P P. Optimized structure of the traffic flow forecasting model with a deep learning approach[J]. IEEE Transactions on Neural Networks and Learning Systems, 2017, 28(10): 2371–2381. DOI:10.1109/TNNLS.2016.2574840 |

| [89] | Koesdwiady A, Soua R, Karray F. Improving traffic flow prediction with weather information in connected cars:a deep learning approach[J]. IEEE Transactions on Vehicular Technology, 2016, 65(12): 9508–9517. DOI:10.1109/TVT.2016.2585575 |

| [90] | Li X, Peng L, Hu Y, et al. Deep learning architecture for air quality predictions[J]. Environmental Science and Pollution Research, 2016, 23(22): 22408–22417. DOI:10.1007/s11356-016-7812-9 |

| [91] | Ding X, Zhang Y, Liu T, et al. Deep learning for event-driven stock prediction[C]//International Joint Conferences on Artificial Intelligence. Buenos Aires, Argentina: IJCAI, 2015: 2327-2333. https://dl.acm.org/doi/10.5555/2832415.2832572 |

| [92] | Zhang J B, Zheng Y, Qi D K, et al. DNN-based prediction model for spatio-temporal data[C]//Proceedings of the 24th ACM SIGSPATIAL International Conference on Advances in Geographic Information Systems. New York, NJ, USA: ACM, 2016: 92. https://www.researchgate.net/publication/312244042_DNN-based_prediction_model_for_spatio-temporal_data |

| [93] | Zhang J B, Zheng Y, Qi D K. Deep spatio-temporal residual networks for citywide crowd flows prediction[C]//AAAI Conference on Artificial Intelligence. San Francisco, California, USA: AAAI, 2017: 1655-1661. https://www.researchgate.net/publication/308809186_Deep_Spatio-Temporal_Residual_Networks_for_Citywide_Crowd_Flows_Prediction |

| [94] | Caruana R. Multitask learning[J]. Machine learning, 1997, 28(1): 41–75. DOI:10.1023/A:1007379606734 |

| [95] | Dürichen R, Pimentel M A F, Clifton L, et al. Multitask Gaussian processes for multivariate physiological time-series analysis[J]. IEEE Transactions on Biomedical Engineering, 2015, 62(1): 314–322. DOI:10.1109/TBME.2014.2351376 |

| [96] | Papagiannopoulou C, Miralles D G, Demuzere M, et al. Detecting Granger-causal relationships in global spatio-temporal climate data via multi-task learning[C]//Proceedings of SIGKDD. New York, NJ, USA: ACM, 2018: 1-8. |

| [97] | Goncalves A R, Banerjee A, Von Zuben F J. Spatial projection of multiple climate variables using hierarchical multitask learning[C]//AAAI Conference on Artificial Intelligence. San Francisco, California, USA: AAAI, 2017: 4509-4515. https://www.researchgate.net/publication/313157804_Spatial_Projection_of_Multiple_Climate_Variables_using_Hierarchical_Multitask_Learning |

| [98] | Zhen X T, Yu M Y, He X F, et al. Multi-target regression via robust low-rank learning[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(2): 497–504. DOI:10.1109/TPAMI.2017.2688363 |

| [99] | Li P, Chen S C. Hierarchical Gaussian processes model for multi-task learning[J]. Pattern Recognition, 2018, 74: 134–144. DOI:10.1016/j.patcog.2017.09.021 |

| [100] | Pan S J, Yang Q. A survey on transfer learning[J]. IEEE Transactions on Knowledge and Data Engineering, 2010, 22(10): 1345–1359. DOI:10.1109/TKDE.2009.191 |

| [101] | Banerjee B, Buddhiraju K M. Domain adaptation in the absence of source domain labeled samples-A coclustering-based approach[J]. IEEE Geoscience and Remote Sensing Letters, 2016, 13(12): 1905–1909. DOI:10.1109/LGRS.2016.2617199 |

| [102] | Sun S C, Liu H B, Meng J N, et al. Substructural regularization with data-sensitive granularity for sequence transfer learning[J]. IEEE Transactions on Neural Networks and Learning Systems, 2018, 29(6): 2545–2557. DOI:10.1109/TNNLS.2016.2638321 |

| [103] | Pan S J, Tsang I W, Kwok J T, et al. Domain adaptation via transfer component analysis[J]. IEEE Transactions on Neural Networks, 2011, 22(2): 199–210. DOI:10.1109/TNN.2010.2091281 |

| [104] | Hu Q H, Zhang R J, Zhou Y C. Transfer learning for short-term wind speed prediction with deep neural networks[J]. Renewable Energy, 2016, 85: 83–95. DOI:10.1016/j.renene.2015.06.034 |

| [105] | Laptev N, Yu J, Rajagopal R. Reconstruction and regression loss for time-series transfer learning[C]//SIGKDD Conference on Knowledge Discovery and Data Mining. New York, NJ, USA: ACM, 2018. |

| [106] | Fawaz H I, Forestier G, Weber J, et al. Transfer learning for time series classification[J]. ArXiv preprint arXiv: 1811. 01533, 2018. https://arxiv.org/abs/1811.01533 |