0 引言

近年来,随着人工智能浪潮的到来,计算机视觉技术如目标检测、图像识别极大改善了人类的生活方式.行人检测是通过计算机技术判断图片或者视频序列中是否包含行人目标并且定位,通过结合其它计算机技术,可以广泛地应用在智能安防.自动驾驶以及人流量监控等场合.在行人检测领域,计算机与人之间仍然存在显著的差距[1].

目前,行人检测算法的研究主要集中在以下两个部分.第一部分是特征提取阶段.文[2]通过对原始图像进行相似变换提取了10个通道的聚合通道特征,包括1个梯度幅值通道、3个颜色通道及6个梯度方向通道.文[3]利用平均人形模板进行手工设计滤波器来生成Haar小波特征.文[4]改进了传统的局部二进制模式(LBP)方法,即邻域差分统计特征.文[5]提出了结合人形先验信息的随机投影特征,获得了更好的检测结果.第二部分是分类器训练阶段.传统机器学习中比较经典的分类器算法主要包括支持向量机(SVM)和集成学习(Boosting)方法[6].文[7]提出了一种带有级联结构与核函数的支持向量机算法.还有一些学者提出附加通道特征的方法,比如利用光流信息,即将相邻帧的信息融入到10个变换通道中.文[8]在行人检测中引入了语义分割.实验结果表明,特征提取量越大,检测器的性能越好.以光流算法为例,向特征通道附加新的特征可以提高检测器的性能,但是缺乏标准的特征提取方法.

由于传统机器学习算法中需要人为设计滤波器,包含一定人为误差,大量基于深度学习的目标检测算法应运而出.通过使用深层神经网络,如卷积神经网络(CNN),随着层数的增加,可以提取更高层次的特征.文[9]将传统行人检测方法中的特征提取和分类阶段集成到深度学习模型中大幅提高了检测性能.融合机器学习与深度学习两种方法也是可行的,文[10]综合利用两种检测器获得了更高的检测精度.

然而检测精度与检测速度之间往往不能兼得,深度学习算法无法满足实时检测的速度要求,本文重点研究传统机器学习算法,即高层次特征提取的通道特征图方法.由于传统的10个通道特征是对原始图像进行相似变换得到的,包含了大量的带有耦合的冗余信息.因此,局部去相关通道特征[2](LDCF)通过主成分分析法进行去相关操作来获得更具鉴别力的特征通道图.传统的去相关方法是对正样本全部区域提取协方差进行去相关操作,忽略了具有高辨识度的区域,导致新的通道特征之间仍然存在一定的耦合信息.在分类阶段,根据决策树节点权重值生成的权重图,提出一种基于平均人体形状不变性的区域选择方法.提出方法的关键点在于找到通道特征图中具有更高行人辨识度的区域,即在分类阶段中该区域特征具有更高的权重,从这些特定区域提取协方差矩阵而不是从正样本全部区域提取协方差,可以更好地去除通道特征间的耦合信息,进而获得更好的检测效果以及更快的检测速度.

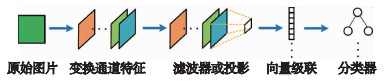

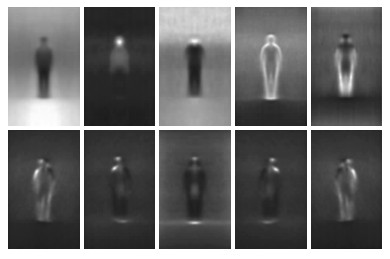

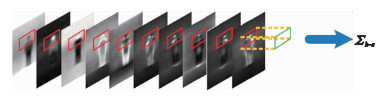

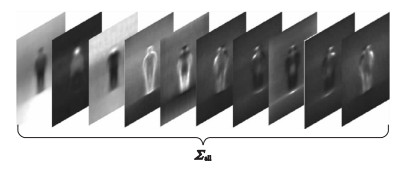

1 去相关聚合通道特征传统行人检测算法包括特征提取和分类器训练两个阶段.常用的提取特征方法包括Haar小波特征、局部二进制特征(LBP)、梯度方向直方图特征(HOG)、颜色空间特征(LUV)、边缘信息等.然而只提取单一特征并不能获得理想的检测效果,将多种通道特征进行融合,如积分通道特征(ICF)[11]、聚合通道特征(ACF)[12]等可以获得更好的检测效果. ICF是通过计算积分图的形式快速计算原始图像的特征通道,在行人检测中使用了10个积分特征通道,包括3个颜色空间通道特征(LUV),1个梯度幅值通道(G)以及6个梯度方向通道特征(ORIG).文[12]提出的ACF特征是对ICF特征的一种改进,其使用的特征通道与ICF相同.但ACF通过对特征通道采取像素块随机查找的方法提取特征,而ICF采用对矩形区域的像素求和的形式获取特征.大量研究行人检测特征提取的算法都可以理解为在提取原始聚合通道特征的基础上进行后处理,行人检测算法整体流程和聚合通道特征的平均人形模板可视化如图 1和图 2所示.

|

| 图 1 行人检测算法流程图 Fig.1 Framework of pedestrian detection algorithms |

|

| 图 2 10个变换通道的平均人形 Fig.2 Average human shape of 10 conversion channels |

文[2]提出的去相关聚合通道特征(LDCF)是对ACF的进一步改进,采用的特征通道与ACF方法相同. ACF通过对输入图像进行通道变换生成10个通道特征,往往包含大量的冗余的相关信息.而Adaboost分类器采用正交决策树模型,更适用于判别无相关信息的向量特征.因此LDCF方法对各个特征通道采用PCA算法进行局部去相关,这将更有利于正交决策树的训练和判别.具体在每个通道上提取协方差矩阵,利用PCA算法学习获取前4大的特征向量,生成滤波器核.为了加速计算,将这4个滤波器核与通道特征图进行卷积.然后将这些特征图进行级联得到最终的LDCF特征,送入Adaboost分类器进行训练.在测试阶段先对输入图像构造ACF通道特征金字塔,采用滑动窗口技术,对候选窗口与滤波器进行卷积计算得到LDCF特征,最后用训练好的分类器进行判别.

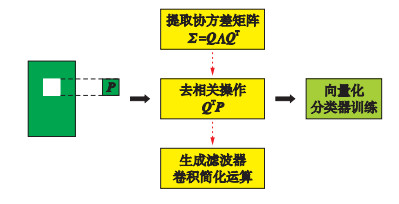

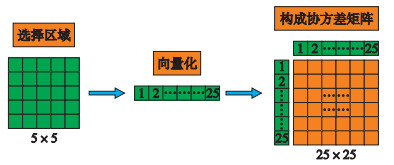

去相关聚合通道特征(LDCF)的算法计算过程如图 3所示,首先从正样本全部区域进行随机采样,区域P(大小为m×m)表示提取协方差矩阵的某一采样区域,Σ是从采样区域提取的可以被所有特征通道共享的协方差矩阵,它是从裁剪后的行人样本中学习得到的.利用特征分解,Σ可分解为QΛQT,其中Q是正交矩阵,Λ是对角矩阵,QTP表示对区域P的去相关操作.对于大小为m×m的采样区域,提取的协方差矩阵大小为m2×m2.由于QTP的矩阵运算时间成本较高,可以通过一系列卷积运算简化去相关计算过程.利用主成分分析法(PCA),根据协方差矩阵Σ前k大的特征值对应的特征向量,导出的Q′大小为m×m×k.因此通过k个滤波器Q′与输入图像的10个特征通道进行卷积运算,可以简化QTP的繁琐计算.对10个变换通道进行去相关后的通道特征将被视为图像的最终特征,最后送入分类器进行训练.同时,通过调整参数,即训练集的大小、滑动窗口步长、滑动窗口大小以及集成学习相关参数可以获得更高的检测性能[12].

|

| 图 3 LDCF的计算过程:水平箭头代表LDCF的主要过程,垂直箭头代表LDCF的加速过程 Fig.3 Calculating process of LDCF: Horizontal arrow represents the main process of LDCF, and vertical arrow represents the acceleration process of LDCF |

Haar小波特征[3]根据平均人形模板进行手工设计滤波器,通过将部分区域像素值的总和与另一部分区域像素值的总和相减获得小波特征,即生成的滤波器只包含1和-1两种权值.文[13]改进了Haar小波特征,基于平均人形模板的统计先验信息提出了粗精尺寸的统计分布特征(CSSD和FSSD).通过利用正、负样本的数据信息分布,并利用了平均人形模板的统计先验信息,将Haar小波特征方法中的滤波器划分成带有具体权重的更精细的区域.具体来讲,权重图是利用线性判别分析法(LDA)从统计的人形模板特征权重图中学习得到的.采用此方法,滤波器可以变得更加复杂并具备提取行人局部细节特征的能力.由此可以得出结论,引入平均人形模板的统计信息,可以大幅提高行人检测效果.

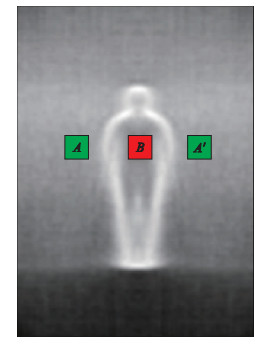

不同于Haar小波特征,文[14]提出一种异侧差分特征(SIDF)与对称相似特征(SSF).异侧差分特征SIDF可以描述背景和行人之间的差异特征及行人轮廓及其内部之间的差异特征. SSF可以描述行人的对称相似性形状特征.对于一个滑动窗口,如图 4所示.首先选取一组对称的区域A和A′,然后在区域A和A′之间随机选取一个区域B,区域B的宽度和位置可变. SIDF特征可以计算为f(A,B)=SA/NA-SB/NB,其中SA和SB是区域A和区域B中采样区域的像素总和,NA和NB是区域A和区域B的面积用于归一化.当滑动窗口扫描到行人区域时,该特征模版可以用来捕获行人轮廓与行人内部之间的差异特征.当滑动窗口扫描到仅带有部分行人的区域时,该特征可以捕获行人与背景之间的差异特征,从而去除了假阳性窗口. SSF特征可以计算为f(A,A′)=|fA-fA′|,其中fA和fA′分别是区域A和区域A′的局部平均特征,因此SSF特征可以充分描述行人的对称相似性特征.

|

| 图 4 平均人形模板的对称与外观不变性 Fig.4 Symmetry and appearance invariance of average humanoid template |

对10个变换通道进行去相关操作是为了提取更有效的表达特征. CSSD和FSSD特征通过引入平均人形模板中的先验信息,将Harr小波模板划分成带有权重的更精细的区域,获得了更高的识别精度. SIDF和SSF特征通过基于平均人形模板的对称性,选取不同区域计算异侧差异特征与对称相似特征,获得了更好的检测效果.基于统计学的人形特征由于考虑了正确的先验信息,提高了行人检测精度. LDCF算法通过对正样本全部区域进行协方差提取,没有考虑任何先验信息,导致去相关操作将忽略掉那些包含更具鉴别力的区域,即去相关不彻底.因此将统计人形先验信息融入到去相关操作中可以获得更好的检测结果.

3 基于平均人形的区域去相关特征 3.1 局部去相关通道特征对输入图像的特征通道进行去相关可以提高正交分类器的分类性能,例如梯度提升决策树. LDCF去相关算法对正样本的全部区域随机采样提取协方差,在一定程度上忽略了一些具有高辨识度的特定区域.所提出的算法对特定的分散的区域提取协方差矩阵,生成的滤波器在测试阶段与每个通道内的整个检测窗口共享.下面分析从特定区域而不是从整个正样本的全部区域中学习协方差矩阵的合理性和可行性.同时,给出了特定区域的分割方法,以实现最佳的检测性能.

LDCF在检测阶段与每个通道内的整个检测窗口共享滤波器.然而,学习到一个可以在各个通道共享的滤波器并不容易.因为在数据集中可以观察到,负样本的数量远超过正样本.基于上述分析,提出的算法将统计人形信息融入到去相关操作中,即只对包含高度鉴别力的特定区域进行协方差矩阵的提取,来实现去相关操作.其合理性包括两点:

1) 从正样本人形的局部区域中获取局部特征是可行的,因为正样本人形区域同样是从行人数据集图像中裁剪得到的,局部区域也可以提取局部特征.

2) 为了加速,LDCF使用前k个特征向量构成的滤波器对原始特征通道进行卷积操作,以简化去相关操作QTP的矩阵计算. QΛQT是从正样本全部区域学习到的协方差矩阵.显然,Q′ΛQ′T同样可以看作是从特定区域中采样学习到的协方差矩阵,故局部区域的去相关也可以通过卷积实现简化运算.

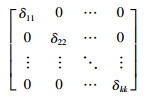

下面分析特定区域的分割方法.通常,分割的类型可以分为通道内级别和跨通道级别.通道内级别区域分割方法根据人形先验信息在每个通道内进行分割,即根据平均人形模板在分类阶段的响应值得到分割区域,然后对该区域随机采样提取协方差矩阵.同时,本文还对正样本图像进行了区域均分,行人重裁剪等,作为对比实验,用来证明当不考虑平均人形先验信息,即头肩区域在分类阶段具有最大的权值时,无法获取最好的检测效果.跨通道级别区域分割方法对多通道学习的协方差矩阵取平均,生成可以被多通道共享的滤波器,跨通道的去相关特征虽未获得最好的检测效果,但是由于滤波器共享,可以减少参数,进而实现检测速度与检测精度之间的最佳平衡.

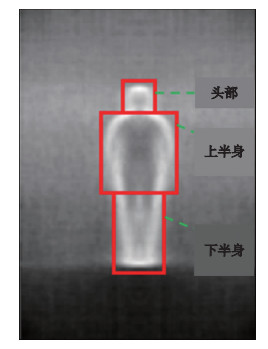

3.2 通道内特定区域去相关特征基于统计学的人形特征将人体形状分为头部、上半身和下半身,如图 5所示,其中平均人形模板是对10个变换通道取平均得到的.在分类阶段,最具鉴别力的区域是头肩区域.对正样本头肩区域而不是像传统LDCF中对正样本全部区域提取协方差,可以获得更好的检测效果.

|

| 图 5 基于统计学的人形特征分割方法 Fig.5 Segmentation of human features based on statistics |

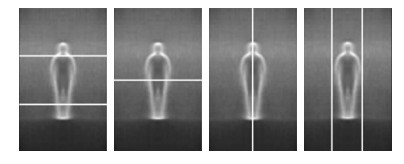

将提取共享协方差矩阵的区域记作SP(大小为m×n),它受检测窗口大小w×h的限制,即m≤w,n≤h. SP的最小范围可以设置为平均人形模板中头部区域的大小.对于分类器来说,头部是最有辨识度的区域,因此不能被裁剪. Σ表示提取的协方差矩阵,对应生成的滤波器为filter(i),提出的算法在每个通道上生成4个5×5的滤波器.

基于通道内分割方法,学习到的滤波器可以表示为

|

(1) |

其中,i=1,2,…,10,j=1,2,…,filter(i)表示用于通道i的滤波器,而Fji表示通道i中特定区域提取的第j个滤波器.每一个滤波器的最终输出将被级联并向量化,最后送入Adaboost分类器进行训练.

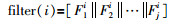

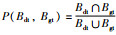

图 6为特征通道的响应图,根据10个变换通道中响应的大小,选择响应度最高的区域来提取协方差矩阵.白色框表示每个通道中可以用于学习在该通道上共享协方差的区域,记作RC.可以看到,RC在所有10个变换通道均包含头肩区域. RC在颜色空间通道(LUV)和梯度幅值通道(G)上包含了全部人体形状.在6个方向梯度通道(ORIG)中,RC仅仅包含具有高响应的区域,因为这些区域是可以表达所有样本中显著特征的区域.将高响应区域作为先验信息进行去相关操作,可以考虑到更多的行人信息,从而提高检测效果.下面提出几种区域分割方法,用于生成滤波器的协方差矩阵将从这些特定区域进行随机采样提取.

|

| 图 6 10个通道特征的响应图 Fig.6 Response charts of 10 channel characteristics |

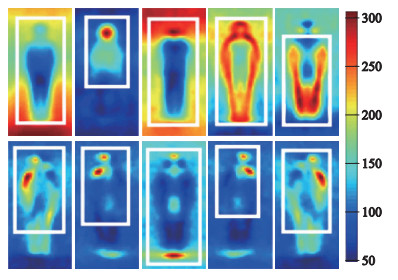

水平和垂直分割方法.作为对比实验,直接将裁剪后的图像均分为几个区域,这些区域大小相等,如图 7所示. LDCF[2]通过对正样本全部区域进行随机采样提取协方差矩阵,取前k大的特征值对应的特征向量进行去相关操作,最后在每个通道生成4个滤波器.前景PCA[10]分别从正样本和负样本学习到4个滤波器,在每个通道上共产生8个滤波器.为了降低时间成本的同时提高检测性能,在将图像等面积分割为2区域或3区域时,在每个通道上生成4个或者6个滤波器.

|

| 图 7 水平和垂直分割方法 Fig.7 Horizontal and vertical segmentation method |

人形区域重裁剪分割.由于正样本中包含一定的背景,因此提出一种正负样本区域分割的方法.显然,反映行人信息相关性的协方差矩阵只能从包含行人的区域中提取.即使正样本是从原始图像裁剪出来的行人区域,仍然可能包含许多非行人区域,使得难以提取可以完全表示行人的协方差矩阵.人形区域重裁剪分割方法通过对裁剪后的正样本再次进行精细裁剪,进而获得更加精确的行人样本,如图 8所示.红框表示从该区域提取协方差矩阵并生成滤波器,学习到的滤波器的大小与LDCF[2]中相同,即每个通道为5×5×4.

|

| 图 8 人形区域精细裁剪分割方法 Fig.8 A fine cropping and segmentation method for humanoid region |

头肩区域重裁剪分割.头肩区域是最具有行人辩识度的区域,根据平均人形模板,如图 9裁剪出正样本中的头肩区域,并对该区域提取协方差矩阵,生成的滤波器在测试阶段与整个滑动窗口进行共享以实现去相关操作.同时,作为对头肩区域分割方法的一种扩展,本文也做了很多从平均人形模板的上半身区域提取协方差的实验.

|

| 图 9 头肩区域精细裁剪分割方法 Fig.9 A fine cropping and segmentation method for head and shoulder region |

与对每个通道内的图像进行区域裁剪分割来提取协方差矩阵相比,本文还提出在跨通道级别进行分割操作,即一个或多个通道共享固定的协方差矩阵.跨通道区域分割方法最终的学习滤波器表示如下:

|

(2) |

其中,向量Ii表示提取协方差矩阵的通道组,FIi表示可以被Ii通道组共享的滤波器.例如,如果相邻通道被设置为可以共享固定的协方差矩阵,那么I=[1, 2],I=[3, 4]等.

全局跨通道共享协方差.通过观察得出,在正样本的通道变换过程中,可能会引起通道间的协方差矩阵互相影响改变.将从正样本的10个通道提取的协方差矩阵进行合成.合成的协方差矩阵将被分解,生成可以被全部通道共享的滤波器,如图 10所示.

|

| 图 10 全局跨通道提取协方差方法 Fig.10 Global cross-channel covariance extraction method |

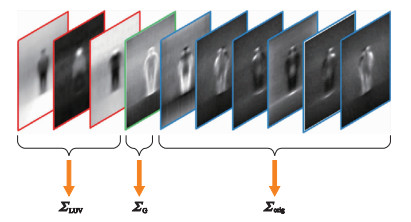

组内跨通道共享协方差.将10个变换通道分为3组:颜色空间通道LUV、梯度幅度通道G和6个梯度方向通道ORIG,下面缩写为LUV_G_ORIG,如图 11所示.每个组内通道的变换会互相影响,因此提出一种组内跨通道共享固定协方差矩阵的方法.将正样本各个组内通道提取的协方差矩阵进行合成,最后生成可以在组内跨通道共享的滤波器.

|

| 图 11 组内跨通道提取协方差方法 Fig.11 Intra-group cross-channel covariance extraction method |

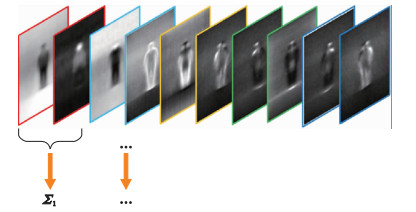

邻域跨通道共享协方差.本文还对相邻通道提取的协方差矩阵进行合成,它们代表了随机组合,作为对比实验,如图 12所示.

|

| 图 12 邻域跨通道提取协方差方法 Fig.12 Neighborhood cross-channel covariance extraction method |

协方差矩阵可以表示为Σ(x,y),(x′,y′)=C(x′-x,y′-y).以通道L为例,对于滑动窗口中大小为5×5的区域P,提取协方差矩阵大小为25×25,如图 13所示.

|

| 图 13 协方差矩阵计算过程 Fig.13 Covariance matrix calculation process |

头肩区域是最具行人表达特征鉴别力的区域,因为行人遮挡往往发生在下半身,头部很少被遮挡,因此头部信息包含量更大.通过对特定区域(头肩部)提取协方差,生成滤波器效果更好.主成分分析法PCA采用最大化投影方差进行降维,即选取包含更多信息的特征投影维度.包含信息越多,方差越大,因此优化目标为最大化投影方差.通过求解坐标变换后的特征方差并利用拉格朗日对偶性,发现最大化投影方差就是最大化协方差矩阵的特征值.

去相关操作的实质就是通过矩阵乘法运算后,将ACF特征的维度减少,去除特征的相关性.对于一个大小为m×n的特征矩阵X,其中m为特征数量,n为特征维度.假设有一个大小为n×k基矩阵P,令Y=XP,则Y大小为m×k,这样m个样本的特征维度从n减小到了k.基矩阵P的选取特别重要,即选择的k个基向量构成的基矩阵P要保证降维后特征的完整性.方差越大,熵越大,包含的信息越多.因此去相关操作应遵循原则:

1) 降维后的特征在各个维度的投影方差越大越好.

2) 不同维度之间特征的相关性越小越好.

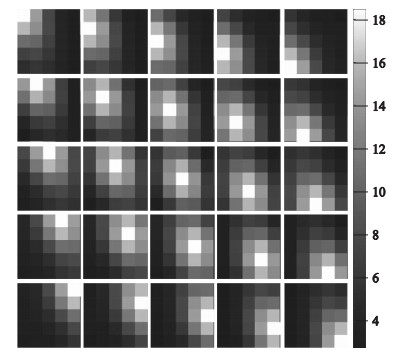

对于正交决策树模型,送入相关性较高的表达特征进行训练,极有可能影响最后的分类效果.根据线性代数知识,对于特征自身的协方差表示其方差,不同特征之间的协方差表示其相关性.因此对于去相关操作的核心就是提取协方差矩阵,优化目标可以用协方差矩阵表示,最理想的协方差矩阵为

|

(2) |

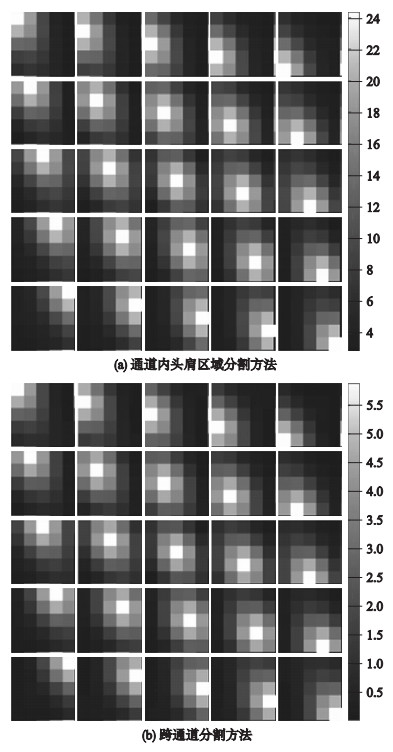

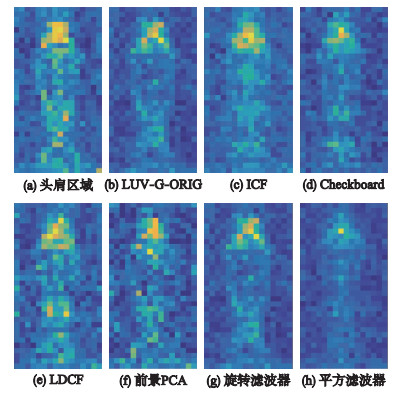

图 14分别是基于通道内区域分割方法对头肩区域提取协方差与基于跨通道区域分割方法对组内提取协方差的可视化.以大小为5×5的区域P为例,最右侧颜色条表示对应的协方差矩阵的值.提取的协方差矩阵要让提取的特征满足方差最大,也即对角线特征值最大,不同特征之间相关性更小,即最理想的情况下不同特征之间相关性为0,如式(2)中非对角线元素.对ACF特征去相关操作后,要保证降维后的特征包含更多的信息,此时协方差矩阵的迹越大越好.由图 14可知,对头肩区域提取的协方差矩阵,颜色栏中的值更大.证明该方法包含信息量更高,去相关操作更加彻底.可以看出,该图由25个5×5的小矩阵组成.设PC表示每个块中具有最高值的像素(如每个小矩阵中的白色像素).每个小矩阵表示PC与5×5区域中的其他像素之间的协方差矩阵.可以看到,相邻的区域是高度相关的.随着PC区域由中心处向外扩张,对应的协方差值也会衰减,区域相关性降低.

|

| 图 14 通道L提取协方差矩阵的可视化 Fig.14 Visualization of channel L extraction covariance matrix |

图 15是在L通道内对头肩区域与跨LUV_G_ORIG通道提取协方差矩阵的差异图,具体是将对头肩区域提取协方差矩阵的值与跨LUV_G_ORIG通道提取平均协方差矩阵的值进行相减得到的.当以PC为中心向外扩张时,协方差矩阵的值会有不同程度的衰减,即随着区域扩大对应的协方差矩阵分辨能力降低.区域P越小,提取的协方差矩阵将包含更多的相关信息,使去相关操作更加有效,这将有助于行人表达特征的提取.在通道内分割方法中裁剪人类形状时,应该考虑这个先验信息.因此可以推测,对作为分类阶段权值最高的头肩区域提取协方差矩阵,可以获得更具鉴别力的表达特征,从而获得更高的检测精度.

4 实验分析 4.1 相关实验设置及可视化分析为了验证提出方法的有效性,分别在INRIA和Caltech-USA行人数据集上进行算法评估实验. INRIA数据集,正样本的总数约为24 740,Caltech-USA数据集,正样本的总数约为24 498.实验设置同文[12],利用最优化参数实现对LDCF的改进.详细设置参数如下:正样本均为从带标签的图像裁剪下来的,针对每个带标签的正样本都施加有一个翻转操作作为数据增强方法,负样本是由背景图自生成的10 000个底片.检测窗口大小设置为128×64,采用下采样操作来缩小原始通道图以减少参数,即128×64×10缩小到64×32×10,学习到的滤波器的大小设置为5×5×4.利用AdaBoost算法进行集成学习,将若干深度为3的决策树集成起来构成一个强分类器,采用5轮循环进行训练(最多4 096个弱分类器).最后,利用公共工具箱[15]和评价工具[15]生成并评价行人检测器.

|

| 图 15 通道L提取协方差矩阵的差异图 Fig.15 Difference map of covariance matrix extracted by channel L |

合适的检测结果衡量指标对于算法评估尤为重要,平均对数漏检率(MR)与每幅图像的假阳性率曲线(FPPI)是衡量检测器性能的有效方法.为了评估行人检测结果,我们使用重叠比

采用的对比算法如LDCF和旋转滤波器,均从正样本图像全部区域提取特征,最后送入分类器进行训练. 图 16所示的权重图是从INRIA数据集上训练的分类器计算得到的,表示AdaBoost决策树在测试阶段节点特征所占的权重.一个特征的权重值越高,对应区域的辨识度就越强.在一定程度上,权重图可以反应出行人检测器的检测能力.选择本文提出的两种分割方法进行比较,分别是通道内方法集中的头肩区域分割方法和跨通道方法集中的LUV_G_ORIG分割方法,因为它们均在各自的方法集中获得了最好的检测性能.可见头肩区域在上述方法中均具有最高的权重,说明了头肩区域的表达特征比其他区域辨识度更高.本文的检测器比其它方法更清晰地描绘了平均人形模板的头肩区域,也就是说,提出的方法为头肩区域分配了更大的权重.通过从变换通道的头肩区域提取协方差矩阵,生成一种新式的滤波器核对原始通道进行去相关,保留了更多的行人显著性信息,再将高辨识度的表达特征送入正交决策树进行训练,可以提升检测器性能.而LDCF算法通过对正样本的全部区域提取协方差矩阵进行去相关,极易破坏行人头肩区域信息的完整性,导致最终提取的行人特征辨识度降低.

|

| 图 16 学习到的权重图 Fig.16 Learned weight map |

图 17分别是基于头肩区域分割方法和传统LDCF提取的协方差矩阵.可以看到,基于头肩区域提取的协方差矩阵左侧颜色栏得分更高,说明此时协方差矩阵可以更多的表示行人特征的相关性.对于相同大小的协方差矩阵,采用对头肩区域提取协方差的方法进行去相关将会更加有效.

|

| 图 17 变换通道提取协方差矩阵的可视化 Fig.17 Visualization of transform channel extraction covariance matrix |

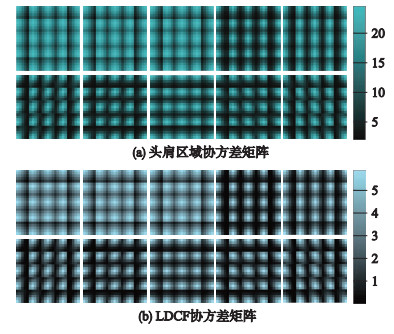

表 1和表 2是在INRIA数据集上行人检测算法的评估结果,在将平均人形模板分割成多个区域时,如水平分割方法,即将正样本均分为上下两个部分,可以捕捉到不同的特征.而垂直分割方法不能很好地捕获行人的显著性特征,因为遮挡主要发生在人体形状的下部,并且垂直分割的方法无法实现对头部区域的去相关操作.基于人形区域精细裁剪分割的方法也比LDCF方法具有更好的特征提取效果,因为这将有利于提取更“纯”的行人表达特征.在跨通道分割方法中,对具体通道上的协方差取平均,在简化计算的同时获得了较低的MR.对头肩区域提取协方差的方法获得了最低的MR为12.23%.可以得出结论,从局部区域学习滤波器的检测能力与其面积大小不成正比,即头肩区域比其它区域更具有辨识度且在分类阶段具有更高的权重.通过通道内区域分割法和跨通道分割法学习的滤波器进行去相关,均能提高行人检测性能.前一种方法稍微优于后一种方法,考虑头肩区域作为分类阶段权重最高的区域,可以获得最好的检测效果.

| 通道内分割方法 | 平均对数漏检率MR /% |

| 头部区域 | 12.30 |

| 人形轮廓 | 13.35 |

| 头肩区域 | 12.23 |

| 全部裁剪(LDCF) | 13.35 |

| 水平分割-2 | 13.19 |

| 水平分割-3 | 12.31 |

| 垂直分割-2 | 14.77 |

| 垂直分割-3 | 15.29 |

| 跨通道分割方法 | 平均对数漏检率MR /% |

| 全局跨通道 | 13.31 |

| 组内跨通道 | 13.30 |

| 邻域跨通道 | 13.88 |

INRIA公共行人数据集训练集共有614张图片,其中包括2 416个行人标签,测试集有288张图片,其中包括1 132个行人标签.利用GPU进行深度网络计算的深度学习方法,如F-DNN[16]、RPN+BF[17],往往不能满足实际实时检测速度的要求.非深度网络行人检测方法也能实现比较好的检测性能,如LDCF、Sketch Tokens[18]和旋转滤波器[19].本文的方法可以看作是LDCF的改进版本,将提出的方法与其它非深度学习的行人检测方法进行比较,对比实验还包括基线方法VJ特征[20]、HOG特征[21]等.

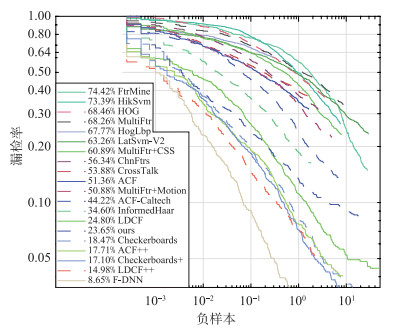

为了公平实验对比,根据LDCF[2]对负样本进行随机裁剪,生成10 000个负样本.滑动窗口大小为64×32,滑动步长设置为4.使用AdaBoost集成学习方法将深度为3的决策树作为分类器进行算法训练.实验结果如图 18所示,其中基于头肩区域提取协方差的方法记作ours.提出的方法优于大多数现有方法,平均对数漏检率MR比LDCF降低了1.56%.证明基于统计平均人形模板的先验信息,即在特定区域提取协方差矩阵学习滤波器,可以对原始变换通道进行更高效的去相关操作,从而提高行人检测效果.

|

| 图 18 INRIA数据集检测结果 Fig.18 INRIA data set detection results |

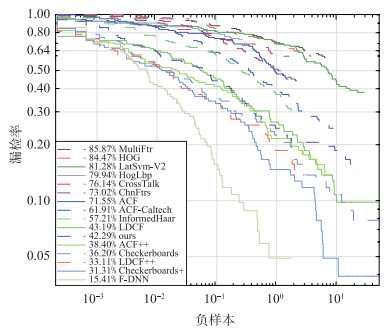

Caltech-USA是美国加州理工大学制作的公共行人数据集,分为训练数据(set00-set05)和测试数据(set06-set10),它们都是从视频中获得的.训练集共有4 250张图片,其中包括6 325个行人标签,测试集共有4 024张图片,其中包括5 051个行人标签.采用文[12]提出的最佳设置,即每3帧从原始视频获得一个训练数据,滑动窗口设置为120×60,滑动步长为2.在Caltech-USA数据集上实验结果如图 19所示.

|

| 图 19 Caltech-USA数据集检测结果 Fig.19 Caltech-USA data set detection results |

与LDCF相比,提出的基于头肩区域学习滤波器的方法不仅可以简化计算,还降低了平均对数漏检率MR. LDCF和本文方法的平均对数漏检率分别为24.8%和23.65%,提出的方法比原始LDCF算法降低了1.15%的MR.基于LDCF的boosting方法获得了更好的性能,如LDCF++[6].然而,LDCF++[6]通常需要大量的训练数据,极其依赖于数据增强方法,进而增加训练时间.提出的方法可以看作是LDCF的一个改进版本,基于数据增强同样可以提高检测性能.对比于采用深度学习的行人检测法,提出的算法可以在单核CPU上运行,非常适合于工程实践应用.

本文还在对部分遮挡(1%~35%遮挡)条件下的Caltech-USA数据集进行了算法评估.评估结果如图 20所示.所有行人检测方法的检测性能随着遮挡的发生均有不同程度的降低,提出的方法在部分遮挡条件下的表现仍然优于原始LDCF算法.说明基于头肩区域学习滤波器,有利于提取高辨识度的行人表达特征. Caltech-USA数据集的遮挡情况主要发生在人体形状的下部,所以提出的算法在遮挡情况下仍然具有较强的鲁棒性.

|

| 图 20 附加遮挡的Caltech-USA数据集检测结果 Fig.20 Results of Caltech-USA data set detection with occlusion |

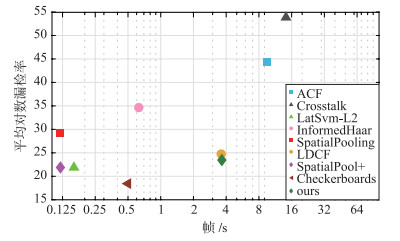

提出的行人检测算法是在一个Intel Core-i5单核CPU上用Matlab实现的.由于深度学习方法均使用GPU进行计算,这里不对其进行比较.在Caltech-USA数据集上几种对比算法的运行时间如图 21所示(在其它不同的机器上运行时间可能发生变化).

|

| 图 21 检测器运行时间结果 Fig.21 Detector run time results |

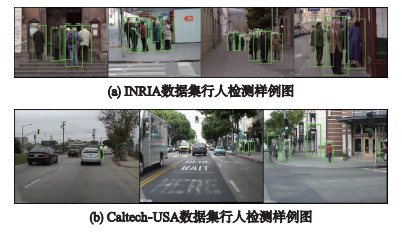

ACF具有更短的运行时间,但同时平均对数漏检率MR较高. SpatialPooling和Checkerboards滤波方法虽然检测性能较好,但运行时间较长,这两种方法都不能兼顾性能和运行时间.提出的方法采用的特征通道图大小与LDCF相同,所以运行时间与LDCF几乎相同,同时获得了比LDCF更好的检测性能.提出的方法在所有非深度学习的行人检测方法中实现了检测速度和检测精度的最佳平衡. 图 22为一些样本检测实例,由于对头肩区域进行了高关注度的特征提取,提出的方法面对遮挡和目标变形的情况具有更强的鲁棒性.

|

| 图 22 行人检测结果实例图 Fig.22 Examples of pedestrian test results |

由于传统变换通道特征之间存在一定冗余信息,直接送入正交决策树分类器进行训练,将严重影响检测精度.通过结合传统去相关操作与基于统计人形先验信息的特征提取方法,根据分类阶段决策树中不同区域特征的权重图,选择平均人形模板中响应最高的区域即头肩区域进行协方差矩阵提取,生成的滤波器在测试阶段与整个滑动窗口共享以提取原始通道特征的去相关信息.基于局部区域学习滤波器的检测能力与其面积大小不成正比,从特定区域提取的协方差矩阵可以包含更多高辨识度的行人信息,从而提升检测器性能.最后提出了特定区域分割方法,分为通道内分割方法和跨通道分割方法.在INRIA和Caltech-USA公共行人数据集上的大量实验,证明基于头肩区域提取滤波器可以捕获行人更深层次的表达特征,保证了行人信息的完整性,从而实现检测速度和检测精度之间的最佳平衡.

| [1] |

胡彬, 邵叶秦.

基于核学习和距离相似度量的行人再识别[J]. 信息与控制, 2017, 46(5): 525–529,542.

Hu B, Shao Y Q. Person re-identification using kernel learning and similarity-distance metric[J]. Information and Control, 2017, 46(5): 525–529,542. |

| [2] | Nam W, Dollar P, Han J H. Local decorrelation for improved pedestrian detection[C/OL]//Neural Information Processing Systems Conference.[2019-02-15]. http://de.arxiv.org/pdf/1406.1134. |

| [3] | Zhang S, Bauckhage C, Cremers A B. Efficient pedestrian detection via rectangular features based on a statistical shape model[J]. IEEE Transactions on Intelligent Transportation Systems, 2015, 16(2): 763–775. |

| [4] | Shen J, Zuo X, Li J, et al. A novel pixel neighborhood differential statistic feature for pedestrian and face detection[J]. Pattern Recognition, 2017, 63: 127–138. DOI:10.1016/j.patcog.2016.09.010 |

| [5] | Zhao Y, Yuan Z, Chen D, et al. Fast pedestrian detection via random projection features with shape prior[C]//Winter Conference on Applications of Computer Vision. Piscataway, NJ, USA: IEEE, 2017: 962-970. |

| [6] | Ohn-Bar E, Trivedi M M. To boost or not to boost? On the limits of boosted trees for object detection[C]//International Conference on Pattern Recognition. Piscataway, NJ, USA: IEEE, 2017: 978-1-5090-4847-2. |

| [7] | Baek J, Kim J, Kim E. Fast and efficient pedestrian detection via the cascade implementation of an additive kernel support vector machine[J]. IEEE Transactions on Intelligent Transportation Systems, 2016, 18(4): 902–916. |

| [8] | Nurhadiyatna A, Loncaric S. Semantic image segmentation for pedestrian detection[C]//Image and Signal Processing and Analysis. Piscataway, NJ, USA: IEEE, 2017: 153-158. |

| [9] | Ouyang W, Zhou H, Li H, et al. Jointly learning deep features, deformable parts, occlusion and classification for pedestrian detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 40(8): 1874–1887. |

| [10] | Zhang S, Benenson R, Schiele B. Filtered channel features for pedestrian detection[C]//Computer Vision and Pattern Recognition. Piscataway, NJ, USA: IEEE, 2015: 1751-1760. |

| [11] | Dollár P, Tu Z, Perona P, et al. Integral channel features[C]//British Machine Vision Conference. London, UK: Springer, 2009. |

| [12] | Bastian B T, Jiji C V. Aggregated channel features with optimum parameters for pedestrian detection[C]//International Conference on Pattern Recognition and Machine Intelligence. Berlin, Germany: Springer, 2017: 55-161. |

| [13] | Shen J, Zuo X, Yang W, et al. Learning discriminative shape statistics distribution features for pedestrian detection[J]. Neurocomputing, 2016, 184: 66–77. DOI:10.1016/j.neucom.2015.08.107 |

| [14] | Cao J, Pang Y, Li X. Pedestrian detection inspired by appearance constancy and shape symmetry[J]. IEEE Transactions on Image Processing, 2016, 25(12): 5538–5551. DOI:10.1109/TIP.2016.2609807 |

| [15] | Wojek C, Dollar P, Schiele B, et al. Pedestrian detection:An evaluation of the state of the art[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(4): 743–761. DOI:10.1109/TPAMI.2011.155 |

| [16] | Du X, El-Khamy M, Lee J, et al. Fused DNN: A deep neural network fusion approach to fast and robust pedestrian detection[C]//Winter Conference on Applications of Computer Vision (WACV). Piscataway, NJ, USA: IEEE, 2017: 978-1-5090-4822-9. |

| [17] | Zhang L, Lin L, Liang X, et al. Is faster R-CNN doing well for pedestrian detection?[C]//European Conference on Computer Vision. Berlin, Germany: Springer International Publishing, 2016: 0302-974. |

| [18] | Lim J J, Zitnick C L, Dollár P. Sketch Tokens: A learned mid-level representation for contour and object detection[C]//Computer Vision and Pattern Recognition. Piscataway, NJ, USA: IEEE, 2013: 978-1-5386-5672-3. |

| [19] | Zhang S, Benenson R, Omran M, et al. How far are we from solving pedestrian detection?[C]//Computer Vision and Pattern Recognition. Piscataway, NJ, USA: IEEE, 2016: 1063-6919. |

| [20] | Viola P, Jones M. Robust real-time face detection[J]. International Journal of Computer Vision, 2004, 57(2): 137–154. DOI:10.1023/B:VISI.0000013087.49260.fb |

| [21] | Dalal N, Triggs B. Histograms of oriented gradients for human detection[C]//Computer Vision and Pattern Recognition. Piscataway, NJ, USA: IEEE, 2005: 1063-6919. |